Методология управления промптами для команд, которые внедряют ИИ в бизнес-процессы

В большинстве компаний промпты живут хаотично: в личных заметках, чатах с коллегами, черновиках документов. Когда таких запросов становится десятки, возникает проблема: как передать рабочий промпт от автора к команде? Как гарантировать, что он не сломается после обновления модели? Как отследить, какая версия работает лучше?

Жизненный цикл промпта — это системный подход к управлению запросами как программным активом. От идеи до интеграции в production, от тестирования до архивации. Эта методология помогает командам стандартизировать работу с нейросетями и избежать потери знаний.

В этой статье мы разберем все этапы lifecycle: от анализа бизнес-задачи до мониторинга результатов в боевых условиях. Каждый этап включает роли, инструменты и чек-листы, которые можно внедрить уже сегодня.

Жизненный цикл языковой модели: путь от идеи до промпт-инжиниринга

Промпт-инжиниринг сегодня — это не просто умение формулировать запросы в чате. Это целая дисциплина, которая объединяет глубокие знания о том, как устроены языковые модели, понимание бизнес-процессов компании и навыки управления корпоративными знаниями. В индустрии ИИ уже сформировалась устоявшаяся концепция lifecycle — набор стандартизированных этапов, через которые должен пройти каждый промпт от первоначальной идеи до запуска в production и далее.

Эволюция подхода к промптам удивительно напоминает то, как кардинально изменилась разработка программного обеспечения за последние 20 лет. Раньше код писали буквально «на коленке» в одиночку, без систематизации. Сегодня это сложный, хорошо организованный процесс с версионированием, обязательным ревью кода и многоуровневым тестированием. Ровно то же самое происходит сейчас с промптами: из разовых экспериментов отдельных сотрудников они постепенно превращаются в стратегический актив компании, который требует системного и методологичного подхода.

Почему lifecycle важен для организаций

На первый взгляд может показаться, что разработка промпта — это просто написать текст в ChatGPT и скопировать результат. На практике, когда организация использует ИИ систематически, возникают серьёзные проблемы без методологии.

Представьте себе ситуацию: в компании работают 50 сотрудников, каждый создаёт свои промпты для разных задач. Никто не знает, какие промпты уже созданы, половина из них не работает после обновления модели, а самый эффективный промпт для генерации описаний товаров хранится в личных заметках уходящего сотрудника. Это приводит к дублированию работы, потере ценных инструментов и невозможности передать опыт новичкам.

Lifecycle решает эту проблему, предоставляя команде единую схему работы: как генерировать идеи, как их тестировать, как готовить к production, как следить за качеством и когда выводить из эксплуатации. Это создаёт предсказуемость и масштабируемость.

Из чего состоит жизненный цикл промпта

| Этап | Описание работы | Основной результат |

|---|---|---|

| 1. Идея | Анализ бизнес-задачи, определение целей и ограничений модели | Техническое задание с требованиями |

| 2. Черновик | Создание первоначальной структуры запроса и инструкций для модели | Draft-версия промпта для тестирования |

| 3. Тестирование | Систематическая проверка на галлюцинации, стабильность и соответствие требованиям | Набор тест-кейсов и метрик качества |

| 4. Ревизия | Улучшение формулировок, добавление контекста, итеративная калибровка | Утверждённая версия для production |

| 5. Production | Интеграция промпта в рабочие системы, API или автоматизированные процессы | Рабочий промпт в операционной системе |

| 6. Мониторинг | Регулярное отслеживание качества ответов и выявление дрейфа модели | Метрики, отчёты и алерты о проблемах |

| 7. Архивация | Сохранение истории версий и знаний для переиспользования в будущем | Структурированная библиотека знаний компании |

Когда lifecycle становится критичным

Этот процесс особенно важен для команд, которые работают с нейросетями не эпизодически, а на постоянной основе. Когда промптов в компании становится больше 10–15, без методологии неминуемо начинается организационный хаос: разные версии одного промпта в разных местах, дублирование работы, потеря наиболее эффективных запросов, невозможность передать знания новым сотрудникам и отсутствие контроля над качеством результатов.

Lifecycle обеспечивает не только организацию, но и качество. Систематическое тестирование выявляет ошибки на ранних этапах, когда их ещё можно исправить без ущерба для бизнеса. Регулярный мониторинг помогает вовремя заметить проблемы, которые возникают после обновления модели провайдером.

Ключевое отличие промпта от просто текста: это инструкция для языковой модели, которая непосредственно влияет на бизнес-результат. Относитесь к нему как к коду — версионируйте, тестируйте, документируйте и проводите регулярное ревью. От качества промпта зависит надёжность всей системы.

Роли и ответственность в lifecycle

Полноценный lifecycle требует распределения ответственности между участниками команды. В классической модели это три роли: автор промпта (создаёт и совершенствует), ревьюер (проверяет качество) и владелец процесса (координирует и принимает решения). В небольших командах эти роли часто совмещают, но даже в этом случае важно чётко понимать, кто за что отвечает.

Без чёткого распределения ролей люди начинают делать дублирующуюся работу или, наоборот, избегают ответственности («думал, это делает кто-то другой»). Это приводит к снижению качества и медленному затуханию инициативы по внедрению ИИ.

Анализ бизнес-задачи: чтобы получить качественный результат

Первый этап lifecycle начинается совсем не с написания промпта, а с тщательного анализа поставленной задачи. Чтобы получить действительно качественный результат от нейросети, нужно чётко и полно понимать: какую именно проблему решаем, для кого её решаем, в каких условиях будет работать промпт и какие ограничения существуют. Без этого понимания вся последующая работа будет построена на зыбком фундаменте.

Этап идеи — это, по сути, стратегическое планирование всего проекта. На этом этапе определяется целевая аудитория промпта (кто именно будет его использовать в компании), желаемый формат ожидаемого ответа (это может быть развёрнутый текст, структурированная таблица, фрагмент кода или что-то ещё) и конкретные критерии успеха для оценки качества. Без этого фундамента даже технически идеальный, грамотно сформулированный промпт может полностью не решить поставленную бизнес-задачу или потребует значительных доработок.

Глубокий анализ: ключевые вопросы на этапе планирования

Проведение качественного анализа требует ответа на систему взаимосвязанных вопросов, которые определяют траекторию всей разработки:

- Конкретная бизнес-задача: Какую именно проблему должен решать промпт? Это генерация текста для маркетинга, комплексный анализ больших объёмов данных, автоматизация рутинных операций, или что-то совершенно другое?

- Целевой пользователь и контекст: Кто будет ежедневно использовать этот промпт? Это специалист-маркетолог, разработчик с техническим образованием, аналитик, непосредственно клиент, или группа сотрудников с разным уровнем подготовки?

- Технические и системные ограничения: Какие именно ограничения наложит на нас выбранная языковая модель? Есть ли лимиты на количество входных или выходных токенов, будет ли у модели доступ к интернету или внутренним базам данных компании, как быстро должна быть выполнена работа?

- Критерии успешного результата: По каким конкретным метрикам мы будем оценивать успех? Это точность классификации, релевантность сгенерированного контента, субъективная оценка качества, или это экономия времени сотрудников?

- Риски и потенциальные проблемы: Существуют ли риски галлюцинаций модели (особенно важно для финансовых или юридических данных), возможна ли утечка конфиденциальной информации, есть ли юридические или этические ограничения на использование ИИ для этой задачи?

Ответы на все эти вопросы совместно формируют техническое задание (ТЗ) — документ, который служит контрактом между заказчиком и разработчиком промпта. ТЗ может быть простым и компактным — одна-две страницы с описанием задачи и несколькими примерами результатов — или очень сложным, содержащим детальные требования к безопасности, интеграциям с существующими системами и регуляторными ограничениями. Главное: зафиксировать все ожидания и договорённости до того, как начнётся разработка, чтобы избежать переделок и разочарований.

Составление гипотез и детальное описание требований

На этапе анализа крайне полезно сформулировать несколько конкурирующих гипотез: какие подходы к разработке промпта потенциально могут сработать лучше других. Например, если бизнес-задача — генерация убедительных коммерческих предложений для клиентов, гипотезы могут выглядеть так:

- Влияние примеров на результат: Промпт с несколькими примерами уже написанных коммерческих предложений (техника few-shot prompting) даст более точный тон и стиль, чем абстрактная общая инструкция без примеров.

- Структура данных для интеграции: Если мы потребуем от модели возвращать результат в структурированном формате JSON, это значительно упростит последующую интеграцию с системой CRM и автоматизацию процесса.

- Оптимальная длина результата: Ограничение длины ответа чётким требованием (например, не более 200 слов) повысит читаемость письма для клиентов и снизит риск того, что они просто не прочитают весь текст.

Эти гипотезы будут проверяться и подтверждаться или опровергаться на следующих этапах разработки (черновик, тестирование, ревизия). Однако уже на этом этапе планирования критически важно документально зафиксировать эти гипотезы, чтобы впоследствии не потерять логику принятых решений. Из-за отсутствия хорошей документации и истории решений команды часто неоднократно возвращаются к одним и тем же ошибкам, изобретая велосипед заново.

Ресурсы и экономическое обоснование

На этапе анализа также важно оценить ресурсы, которые потребуются на разработку, и экономическое обоснование проекта. Сколько человеко-часов понадобится? Какой будет стоимость использования API для тестирования и production? Какой будет возврат на инвестицию через сокращение времени на рутинные операции?

Команды, которые систематически тратят 20–30% от общего времени разработки на тщательный анализ задачи до написания первой строки промпта, в среднем сокращают количество необходимых итераций в 2.5 раза. Это приводит к существенной экономии времени и значительно повышает эффективность всего процесса внедрения ИИ в бизнес-процессы.

Разработка черновика: как качество ответа зависит от контекста

Этап черновика — это перевод технического задания в конкретную инструкцию для модели. Здесь формируется база промпта: структура запроса, системные инструкции, примеры и ограничения. Качество ответа напрямую зависит от того, насколько точно сформулирован контекст.

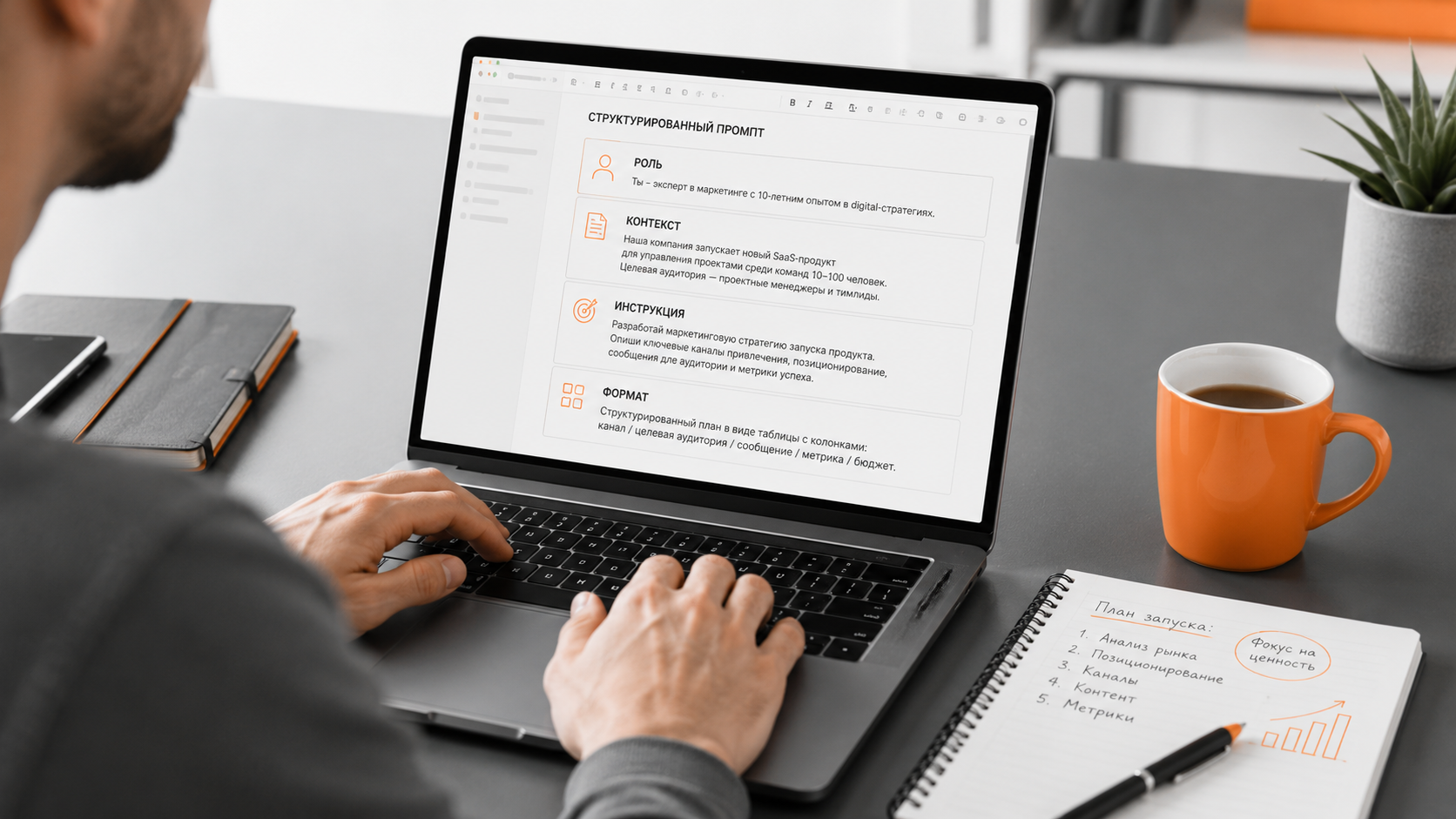

Хороший черновик промпта включает три элемента: роль модели, контекст задачи и формат ответа. Например, вместо «напиши статью про ИИ» лучше работает структурированная инструкция с чёткими рамками.

Структура базового промпта

Классическая структура включает следующие блоки:

- Роль: кем должна «быть» модель (эксперт, редактор, аналитик)

- Контекст: какая задача стоит, для кого результат, какие ограничения

- Инструкция: что именно нужно сделать (написать, проанализировать, сравнить)

- Формат: как должен выглядеть ответ (список, таблица, текст с заголовками)

- Примеры: если нужен определённый стиль или тон

Эта структура помогает модели понять контекст и снижает вероятность получения общего или нерелевантного ответа. Работа над черновиком — это поиск баланса между детализацией и гибкостью.

Роль контекста в формулировках

Контекст — это то, что отличает сильный промпт от слабого. Модель не знает, кто вы, какой у вас бизнес и какие задачи вы решаете. Если не объяснить это в запросе, она будет генерировать усреднённый ответ.

Пример слабого промпта: «Напиши текст для рекламы». Модель не понимает: реклама чего, для кого, в каком канале, какой длины, какой стиль.

Пример сильного промпта с контекстом:

Задача: написать текст для email-рассылки.

Целевая аудитория: руководители отделов продаж в IT-компаниях.

Цель письма: пригласить на вебинар про автоматизацию CRM.

Формат: короткий текст (до 150 слов), дружелюбный тон, без агрессивных продаж.

Структура: заголовок, 2 абзаца, призыв к действию.

Такой промпт даёт модели всё необходимое для генерации релевантного текста. Чем точнее контекст, тем выше качество ответа и тем меньше итераций потребуется для доработки.

Черновик — это не финальная версия. Это отправная точка для тестирования. Не пытайтесь сделать идеальный промпт с первого раза. Итерации — нормальная часть процесса.

Тестирование данных, которые выдаёт ИИ: поиск оптимальной формулировки

После создания черновика начинается самый критичный этап — тестирование. Именно здесь выясняется, насколько стабильно работает промпт, даёт ли он предсказуемый результат и не склонен ли к галлюцинациям. Тестирование — это не одноразовая проверка, а итеративный процесс калибровки формулировок под конкретную задачу.

ИИ может выдавать разные ответы на один и тот же запрос. Это связано с вероятностной природой языковых моделей: каждый раз генерация проходит с элементом случайности. Задача тестирования — найти формулировку, которая минимизирует отклонения и максимизирует качество данных на выходе.

Что проверяем на этапе тестирования

Тестирование промпта включает несколько направлений проверки. Каждое из них отвечает на конкретный вопрос о надёжности запроса.

- Стабильность: даёт ли промпт одинаковый по качеству результат при повторных запросах?

- Галлюцинации: не придумывает ли модель факты, даты, цифры или источники?

- Соответствие формату: возвращает ли ИИ данные в нужной структуре (список, таблица, JSON)?

- Релевантность: отвечает ли результат на поставленный вопрос или уходит в сторону?

- Тон и стиль: соблюдается ли заданный стиль общения (формальный, дружелюбный, экспертный)?

Для проверки используется выборка тест-кейсов — набор типичных входных данных, на которых промпт должен показать стабильный результат. Например, если промпт генерирует описания товаров, тест-кейсы могут включать 10–15 разных категорий продуктов.

Методы выявления галлюцинаций

Галлюцинации — одна из главных проблем при работе с ИИ. Модель может уверенно назвать несуществующую статистику, сослаться на вымышленное исследование или указать неверную дату. Это особенно опасно в бизнес-контексте, где ошибка в данных влияет на решения.

Чтобы снизить риск галлюцинаций, на этапе тестирования применяются следующие техники:

- Проверка фактов: если промпт работает с конкретными данными (даты, цифры, имена), всегда проверяйте их вручную в первых 5–10 итерациях.

- Ограничение фантазии: добавьте в промпт явную инструкцию «Если не знаешь точного ответа — скажи об этом, не придумывай».

- Использование источников: если модель имеет доступ к базе знаний или интернету, требуйте ссылки на источники в ответе.

Калибровка параметров модели также влияет на стабильность. Параметр temperature (температура) управляет креативностью: низкие значения (0.1–0.3) дают более предсказуемые ответы, высокие (0.7–1.0) — более разнообразные, но менее стабильные. Для бизнес-задач обычно используются низкие значения.

Итеративная калибровка запроса

Редко когда промпт работает идеально с первого раза. Тестирование — это серия итераций: запустили на 10 примерах, нашли слабые места, скорректировали формулировку, протестировали снова. Обычно требуется 3–5 итераций, чтобы довести промпт до production-ready состояния.

Сравнение результатов между итерациями помогает понять, какие изменения улучшают качество. Для этого создаётся простая таблица: версия промпта, тест-кейс, результат, оценка качества (по шкале 1–5). Это позволяет объективно оценить прогресс.

Команды, которые проводят структурированное тестирование с выборкой из 15–20 кейсов, снижают количество ошибок в production на 60% по сравнению с теми, кто тестирует промпт на 2–3 примерах.

Тестирование — это не поиск идеального промпта, а поиск достаточно стабильного. Если промпт работает корректно в 80–90% случаев, это уже хороший результат для большинства бизнес-задач.

Продвинутый уровень: Chain of Thought для решения сложных задач

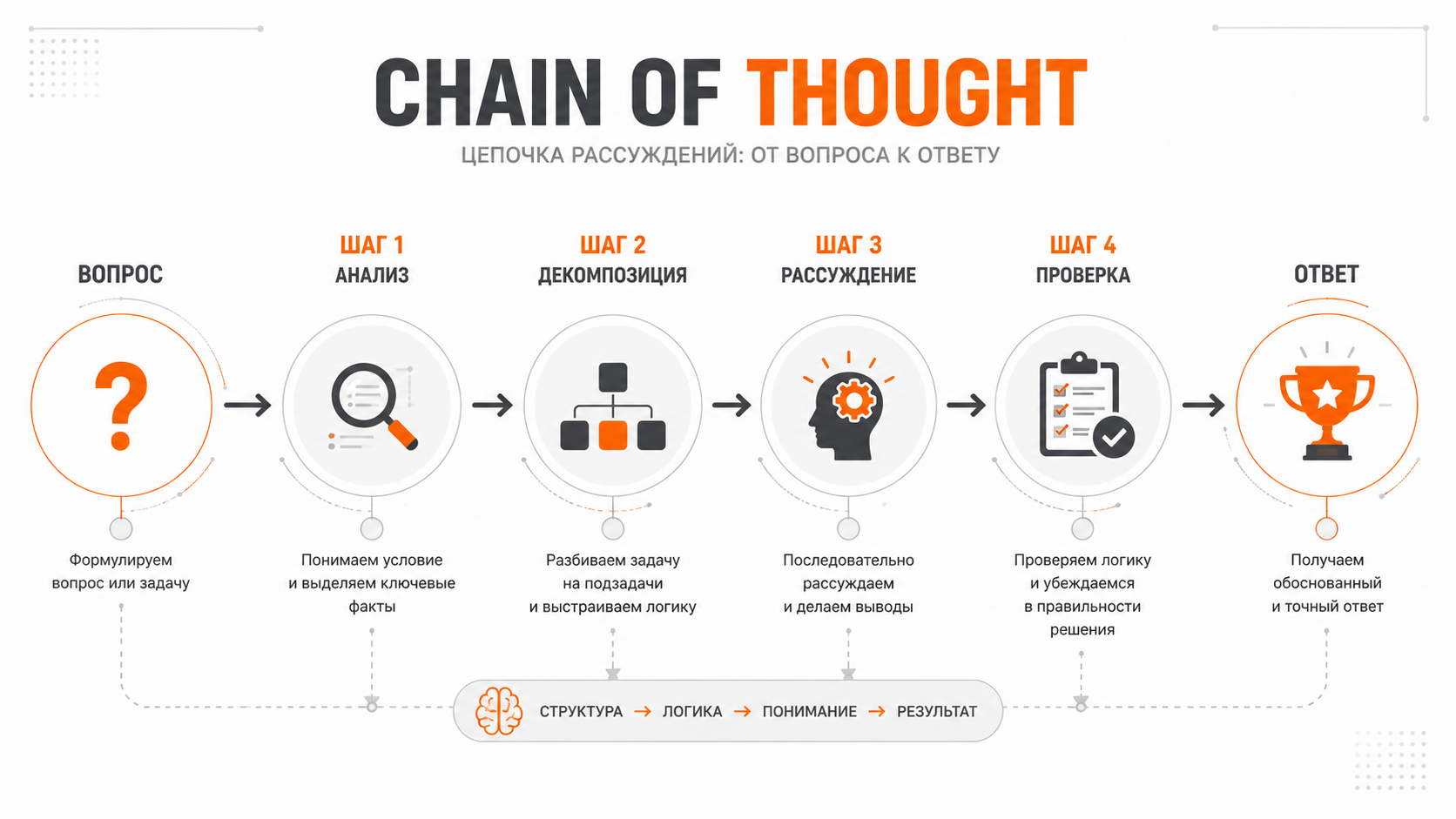

Когда команда освоила базовые техники создания промптов, неизбежно возникает потребность в решении значительно более сложных, многогранных задач: многоступенчатый аналитический анализ больших объёмов информации, построение логических цепочек с множеством условий, задачи с неоднозначными или противоречивыми условиями. Здесь простые и прямолинейные подходы уже не работают. На помощь приходят продвинутые техники промпт-инжиниринга, главная из которых — Chain of Thought, или цепочка рассуждений.

Chain of Thought — это инновационный метод, при котором языковая модель не сразу выдаёт финальный ответ, как чёрный ящик, а пошагово, детально описывает всю логику своих рассуждений и промежуточные выводы. Это методологическое изменение качественно повышает точность и надёжность на задачах, требующих глубоких логических рассуждений: сложные математические расчёты, детальный анализ причинно-следственных связей между событиями, принятие стратегических решений на основе анализа множества взаимосвязанных факторов.

Как работает Chain of Thought и почему это критично

Рассмотрим два контрастных подхода к одной задаче. Классический промпт для анализа финансовой задачи может выглядеть совершенно просто: «Посчитай рентабельность инвестиционного проекта». Модель выдаст вам ответ — скажем, «ROI составляет 45%». Но здесь есть критическая проблема: вы не видите, как модель пришла к этому числу. Если в расчётах спрятана ошибка, если модель неправильно интерпретировала входные данные или забыла учесть какие-то расходы — вы это не заметите. Вы получаете цифру, но теряете возможность проверить логику.

Промпт с применением методики Chain of Thought формулируется совершенно по-другому, максимально структурированно:

1. Определи все источники доходов и суммируй их

2. Определи все категории расходов и суммируй их

3. Рассчитай чистую прибыль (доходы минус расходы)

4. Раздели чистую прибыль на все расходы

5. Умножь результат на 100 для получения процента

6. Покажи финальное значение ROI

7. Объясни, какие факторы повлияли на этот результат

При таком подходе модель не просто выдаёт итоговую цифру, а предоставляет развёрнутое, прозрачное решение со всеми промежуточными этапами и расчётами. Это даёт вам несколько критических преимуществ: во-первых, вы можете на каждом шаге проверить логику и найти ошибки; во-вторых, если модель учла не все расходы или неправильно интерпретировала данные, это будет видно уже на этапе определения расходов; в-третьих, вы получаете полное объяснение результата, а не просто число.

Few-shot prompting: обучение модели через примеры

Ещё одна мощная и практически проверенная техника для решения сложных задач — few-shot prompting, буквально «обучение на нескольких примерах». Суть метода в том, что вы даёте языковой модели несколько конкретных примеров правильного решения вашей задачи, и модель на их основе учится в рамках одного запроса и применяет эти паттерны к новым данным. Это особенно полезно, когда требуется очень специфический стиль, тон или формат ответа, которые сложно описать словами.

Пример few-shot промпта для генерации заголовков в специфическом стиле:

Пример 1:

Тема статьи: рост инфляции в стране

Желаемый заголовок: «ЦБ повысил ключевую ставку: что это значит для вашего бизнеса»

Пример 2:

Тема статьи: новый закон о защите персональных данных

Желаемый заголовок: «Как компаниям подготовиться к ужесточению требований GDPR: пошаговый план действий»

Пример 3:

Тема статьи: новая технология в производстве

Желаемый заголовок: «Робототехника на конвейерах: почему крупные заводы переходят на автоматизацию уже сейчас»

Теперь создай заголовок для темы: внедрение ИИ в производственные процессы

Модель не просто увидит, какой формат нужен — она уловит более глубокие паттерны: привлечение читателя через вопрос или утверждение, ориентация на практическую пользу для бизнеса, использование конкретных примеров. Few-shot prompting работает значительно эффективнее, чем длинные многостраничные описания требуемого стиля, потому что примеры говорят больше, чем тысяча слов инструкций.

Комбинирование техник для максимальной эффективности

Для решения особо сложных, комплексных задач можно и нужно комбинировать несколько продвинутых техник вместе. Например, создать единый мощный промпт, который сначала анализирует исходные данные через методику Chain of Thought, затем формулирует выводы на основе предоставленных примеров (few-shot), а в самом конце структурирует финальный результат в заранее определённом формате (JSON, таблица, список).

Такой комплексный подход требует больше вычислительных ресурсов — больше токенов и больше времени на выполнение — но результаты заметно превосходят простые методы. Уровень детализации и структурированности в промпте напрямую влияет на качество выходного результата: чем сложнее стоящая перед вами задача, тем критичнее разбить её на логические этапы и дать модели чёткие инструкции на каждом шаге.

Цепочки рассуждений и комбинированные методики особенно ценны и дают максимальный результат в таких областях как сложная аналитика данных, финансовое моделирование и прогнозирование, юридические консультации и анализ контрактов, техническая поддержка с диагностикой проблем, стратегическое планирование и принятие решений — везде, где критична полная прозрачность логики рассуждений и где результат невозможно проверить по простой формуле.

Chain of Thought увеличивает расход токенов (иногда в 2–3 раза) и замедляет обработку, но повышает надёжность и точность результатов. Для критичных бизнес-задач, где стоимость ошибки высока, это полностью оправданная цена за снижение риска серьёзных ошибок и увеличение доверия к результатам ИИ.

Интеграция в производство: большие языковые модели в бизнес-процессах

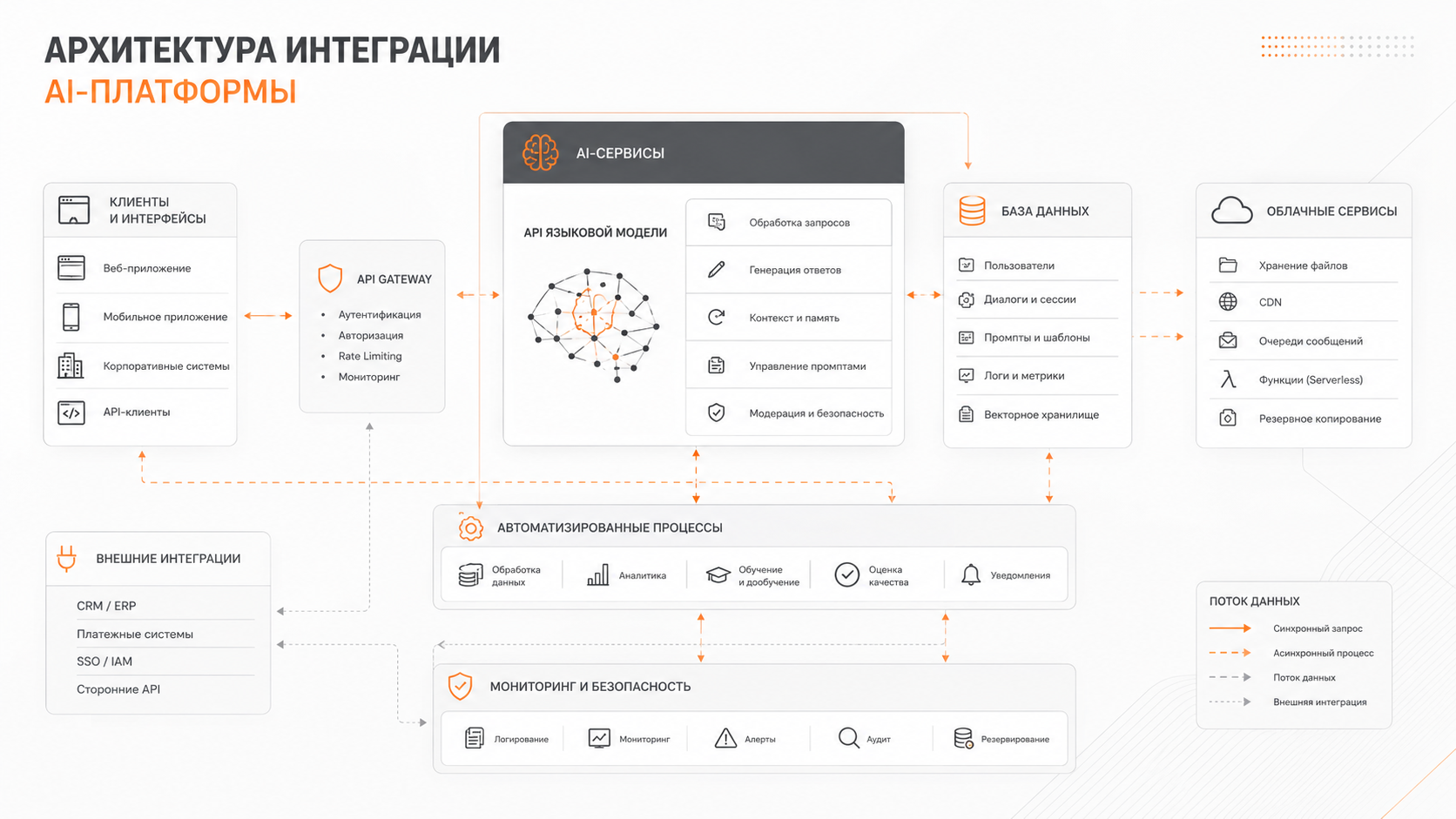

Когда промпт протестирован и утверждён, наступает этап интеграции в production. Это перенос рабочего запроса из экспериментальной среды в реальные бизнес-процессы: API, автоматизированные скрипты, корпоративные сервисы. Здесь промпт становится частью инфраструктуры компании.

Интеграция больших языковых моделей в работу требует не только технических навыков, но и понимания архитектуры системы. Промпт должен стабильно работать под нагрузкой, корректно обрабатывать ошибки и не создавать узких мест в процессе.

Способы интеграции промптов

Существует несколько распространённых сценариев внедрения промптов в бизнес:

- API-интеграция: промпт вызывается через API (OpenAI, Anthropic, локальные модели). Это универсальный способ для автоматизации.

- Python-скрипты: создание автономных программ, которые обрабатывают данные через нейросеть (например, ежедневный анализ отзывов клиентов).

- No-code платформы: использование сервисов типа Zapier, Make или n8n для интеграции без программирования.

- Встроенные ассистенты: добавление ИИ в корпоративные чаты (Slack, Telegram) или CRM-системы.

Выбор метода зависит от технической зрелости команды и масштаба задачи. Для небольших компаний подходят no-code решения, для крупного бизнеса — полноценная разработка с версионированием и мониторингом.

Управление версиями и безопасность

В production-среде критически важно управление версиями промптов. Если промпт обновляется, старая версия должна быть сохранена на случай отката. Это особенно актуально, когда обновления модели (например, переход с GPT-4 на GPT-4.5) могут изменить поведение запроса.

Система версионирования может быть простой: папка с файлами, где каждый промпт имеет номер версии и дату создания. Или сложной: использование Git для хранения промптов как кода, с ветками и pull request'ами перед внедрением.

Безопасность — ещё один ключевой аспект. Промпты, работающие с клиентскими данными, должны соответствовать политике конфиденциальности компании. Это значит:

- Не передавать персональные данные в открытые API без анонимизации

- Использовать корпоративные аккаунты с отключённым обучением на данных

- Логировать все запросы для аудита и контроля качества

Автоматизация и стабильность работы

После интеграции промпт становится частью автоматизированного процесса. Например, он может ежедневно генерировать отчёты, отвечать на вопросы клиентов или обрабатывать заявки. Стабильность здесь критична: если промпт падает или выдаёт некорректный результат, это влияет на весь процесс.

Для обеспечения стабильности используются следующие функции:

- Обработка ошибок: если API недоступен или модель не отвечает, система должна корректно обработать ситуацию (повторить запрос, уведомить администратора).

- Резервные варианты: если основная модель недоступна, можно автоматически переключиться на альтернативную.

- Лимиты и квоты: контроль расхода токенов, чтобы избежать перерасхода бюджета.

Автоматизация с помощью ИИ экономит время, но требует надёжной инфраструктуры. Чем критичнее процесс, тем важнее тестирование и мониторинг на этапе внедрения.

Компании, которые внедряют систему версионирования и мониторинга промптов, сокращают время на устранение ошибок в production на 50% и повышают стабильность работы автоматизированных процессов.

Работа промпт-инженера: мониторинг и поддержка систем

После запуска промпта в production начинается этап, который многие недооценивают — мониторинг и поддержка. Промпт-инжиниринг не заканчивается на моменте внедрения. Большие языковые модели регулярно обновляются, изменяется их поведение, и то, что работало отлично месяц назад, может начать давать сбои сегодня. Это явление называется LLM drift — дрейф модели.

Работа промпт-инженера на этапе поддержки включает три ключевых направления: контроль качества результатов, отслеживание изменений в поведении модели и своевременное обновление промптов. Без системного мониторинга даже самый качественный промпт со временем теряет эффективность.

Что такое LLM drift и почему он возникает

LLM drift — это постепенное изменение качества ответов модели из-за обновлений её параметров или обучающих данных. Провайдеры моделей (OpenAI, Anthropic, Google) регулярно выпускают новые версии, которые могут вести себя иначе на тех же самых промптах.

Например, модель GPT-4 в январе может генерировать краткие ответы, а после обновления в марте — начать давать более развёрнутые тексты. Если ваш промпт рассчитан на короткие ответы (например, для SMS-рассылки), это создаст проблему. Результат перестанет соответствовать требованиям, и процесс сломается.

Ещё одна причина drift — изменение контекста использования. Если промпт создавался для одной задачи, а со временем его начали применять для других, качество может снизиться. Мониторинг помогает вовремя обнаружить такие отклонения.

Инструменты контроля качества

Для отслеживания стабильности результатов используются метрики и регулярные проверки. Вот основные подходы к мониторингу:

- Логирование запросов: сохранение всех промптов и ответов позволяет анализировать историю и находить моменты, когда качество начало падать.

- Выборочная ревизия: менеджер или ревьюер периодически (раз в неделю или месяц) проверяет случайную выборку из 20–30 результатов и оценивает их качество.

- Автоматические тесты: если промпт возвращает структурированные данные (JSON, таблицы), можно настроить автоматическую проверку формата и ключевых полей.

- Обратная связь от пользователей: если промпт используют сотрудники или клиенты, их отзывы — ценный источник информации о проблемах.

Мониторинг не требует ежедневного ручного контроля, но должен быть регулярным. Оптимальная частота — еженедельная выборочная проверка плюс автоматические алерты при критических ошибках (например, если модель возвращает пустой ответ или ошибку формата).

Роли в процессе поддержки

На этапе maintenance появляются чёткие роли, которые распределяются между участниками команды:

- Автор промпта: тот, кто создал и внедрил запрос. Отвечает за обновления и улучшения.

- Ревьюер: проверяет качество результатов, выявляет отклонения, фиксирует проблемы.

- Менеджер процесса: координирует работу, принимает решения об обновлении или откате версий.

В небольших командах один человек может совмещать все три роли. В крупных компаниях это разные сотрудники, что обеспечивает независимую проверку и снижает риск пропуска ошибок.

Обновление промптов и управление версиями

Когда мониторинг выявляет проблему, промпт нужно обновить. Здесь критически важна история версий: перед внесением изменений текущая версия сохраняется как архивная. Если обновление ухудшит результат, можно быстро вернуться к предыдущей версии.

Процесс обновления выглядит так: обнаружена проблема → создан черновик исправленного промпта → протестирован на тех же тест-кейсах → внедрён в production → мониторинг результатов. Полный цикл обновления занимает от нескольких часов до нескольких дней, в зависимости от сложности задачи.

Регулярные обновления — нормальная часть работы с ИИ. Модели развиваются, бизнес-задачи меняются, и промпты должны адаптироваться. Команды, которые выстраивают процесс поддержки с первого дня, экономят время и избегают критических сбоев в будущем.

Компании, которые внедряют систематический мониторинг промптов, выявляют проблемы в среднем на 2–3 недели раньше, чем те, кто проверяет результаты только по жалобам пользователей. Это снижает риск репутационных потерь и финансовых убытков.

Этика искусственного интеллекта и безопасность корпоративных данных

Внедрение ИИ в бизнес-процессы неизбежно поднимает вопросы этики и безопасности. Когда нейросети обрабатывают данные клиентов, финансовую информацию или внутренние документы компании, риски утечек и нарушений конфиденциальности становятся критичными. Каждая организация должна выработать политику работы с ИИ, которая защищает как бизнес, так и пользователей.

Безопасность корпоративных данных при работе с промптами — это не техническая деталь, а вопрос юридической ответственности. Неправильное использование ИИ может привести к утечке персональных данных, нарушению GDPR или других норм защиты информации, и как следствие — к штрафам и репутационным потерям.

Основные риски при работе с данными

Когда промпт отправляется в облачный API (например, OpenAI или Anthropic), данные покидают внутреннюю инфраструктуру компании. Это создаёт несколько типов рисков:

- Обучение модели на ваших данных: некоторые провайдеры используют запросы пользователей для дообучения моделей. Это значит, что конфиденциальная информация может стать частью знаний ИИ и теоретически попасть в ответы другим пользователям.

- Утечка через логи: запросы и ответы сохраняются в системах провайдера. Если доступ к ним недостаточно защищён, данные могут быть скомпрометированы.

- Человеческий фактор: сотрудники могут случайно или намеренно передать в промпт данные, которые не должны покидать компанию (имена клиентов, финансовые отчёты, технические секреты).

Каждый из этих рисков требует отдельных мер защиты. Политика компании должна чётко регламентировать, какие данные можно передавать в ИИ, а какие — нельзя ни при каких обстоятельствах.

Анонимизация и контроль доступа

Один из базовых методов защиты — анонимизация данных перед отправкой в нейросеть. Вместо реальных имён клиентов используются условные обозначения (Клиент А, Клиент Б), вместо конкретных цифр — диапазоны или усреднённые значения. Это позволяет использовать ИИ для анализа, не раскрывая чувствительную информацию.

Контроль доступа — ещё один уровень защиты. Не все сотрудники должны иметь право отправлять данные в нейросеть. Доступ к корпоративным аккаунтам с ИИ предоставляется только тем, кто прошёл обучение и понимает политику конфиденциальности. Это снижает риск случайных утечек.

Для особо критичных данных используются локальные модели или корпоративные версии API с гарантией, что информация не покидает защищённый контур. Такие решения дороже, но обеспечивают необходимый уровень безопасности для финансового сектора, медицины и государственных структур.

Юридические аспекты и права на результаты

Ещё один важный вопрос — кому принадлежат права на текст или код, сгенерированный ИИ? В большинстве юрисдикций авторское право на результаты работы нейросети либо отсутствует, либо принадлежит тому, кто сформулировал запрос (но это зависит от условий использования конкретного сервиса).

Компаниям важно понимать: если ИИ сгенерировал текст на основе чужих данных (например, скопировал фрагмент из защищённого источника), это может создать юридические проблемы. Поэтому все материалы, созданные с помощью нейросетей, должны проходить проверку на уникальность и соответствие нормам использования контента.

Политика компании должна включать чёткие правила: что можно публиковать без проверки, что требует ревью юристов, а что вообще запрещено генерировать с помощью ИИ (например, медицинские или юридические консультации без участия специалистов).

Защита данных — это не только техническая задача, но и организационная. Обучите команду правилам работы с ИИ, создайте чек-лист проверки перед отправкой данных в нейросеть и регулярно аудируйте процессы.

Библиотека BestpromptAI: как хранить промпты эффективнее

Когда количество промптов переваливает за десяток, хранение их в заметках или текстовых файлах становится неудобным. Поиск нужного запроса занимает время, версии путаются, коллективная работа превращается в хаос. Решение — использовать специализированные инструменты для управления библиотекой промптов.

BestpromptAI — это сервис, который позволяет систематизировать работу с промптами: хранить их в структурированном виде, помечать, добавлять в свою коллекцию для быстрого поиска и делиться с коллегами. Это превращает хаотичную коллекцию запросов в управляемую базу знаний.

Основные возможности библиотеки

Современная библиотека промптов должна закрывать несколько базовых потребностей команды:

- Быстрый поиск: найти нужный промпт за несколько секунд по ключевым словам, тегам или категориям.

- Версионирование: хранить историю изменений каждого промпта, чтобы можно было откатиться к предыдущей версии.

- Шаблоны: создавать базовые структуры промптов, которые можно переиспользовать для новых задач.

BestpromptAI реализует все эти функции в удобном интерфейсе. Это работает как облачное хранилище, но заточенное именно под специфику промпт-инжиниринга.

Моя коллекция и категоризация

Каждый промпт можно найти по нескольким категориям: по типу задачи (генерация текста, анализ данных, код), по отделу (маркетинг, продажи, разработка).

Это позволяет быстро фильтровать библиотеку. Например, маркетолог может за пару кликов найти все утверждённые промпты для генерации рекламных текстов, работающие на Claude. Без категорий пришлось бы вручную просматривать десятки записей.

Категоризация также помогает новым сотрудникам быстро разобраться в структуре: они видят, какие промпты используются для каких задач, и могут адаптировать их под свои нужды, не изобретая велосипед.

Интеграция с рабочими процессами

Библиотека удобна не только для хранения, но и для интеграции в ежедневные процессы. Промпты можно экспортировать в текстовые файлы, копировать в API-скрипты или использовать прямо из интерфейса. Это экономит время: не нужно искать файл в папке, достаточно открыть библиотеку и скопировать актуальную версию.

Создание собственной коллекции шаблонов — ещё одно преимущество. Вы фиксируете лучшие практики команды и превращаете их в готовые заготовки. Новый сотрудник получает доступ к библиотеке и сразу видит, как формулируются промпты в вашей компании.

Команды, которые используют структурированные библиотеки промптов, сокращают время на поиск и адаптацию запросов на 60% и снижают количество дублирующихся промптов на 70%.

Библиотека промптов — это не просто инструмент хранения. Это база знаний компании, которая накапливает экспертизу и передаёт её новым сотрудникам. Инвестиция в систематизацию окупается уже через несколько месяцев работы.

FAQ: всё, что должен знать специалист по lifecycle промптов

Собрали ключевые вопросы, которые возникают у команд при внедрении систематического подхода к управлению промптами. Здесь — практические рекомендации экспертов и пошаговые ответы на технические и организационные задачи.

▸Какая модель лучше для разных этапов lifecycle — GPT-4, Claude или Gemini?

Выбор модели зависит от конкретного этапа цикла и типа задачи. Вот краткие рекомендации:

GPT-4 (OpenAI): универсальный выбор для большинства бизнес-задач. Хорошо работает на этапах черновика, тестирования и production. Сильные стороны — структурирование данных, генерация кода, работа с таблицами и JSON. Подходит для технических промптов и интеграции через API.

Claude 3.5 Sonnet (Anthropic): лучший выбор для задач, требующих развёрнутых текстов и аналитики. Сильнее в цепочках рассуждений (Chain of Thought), генерации маркетинговых текстов и работе с большими объёмами контекста. Подходит для этапов ревизии и создания контента.

Gemini (Google): хорош для мультимодальных задач (текст + изображения) и интеграции с экосистемой Google. Менее популярен в корпоративном секторе, но может быть полезен для команд, работающих в Google Workspace.

Для критичных production-процессов рекомендуется тестировать промпт на нескольких моделях и выбирать ту, которая даёт наиболее стабильный результат для вашей конкретной задачи.

▸Как рассчитать стоимость использования промптов и оптимизировать расход токенов?

Стоимость работы с ИИ зависит от количества токенов (условных единиц текста), которые обрабатывает модель. В среднем один токен — это примерно 4 символа на английском или 2–3 на русском языке.

Базовые цены (на начало 2026):

- GPT-4: ~$0.03 за 1000 входных токенов, ~$0.06 за 1000 выходных

- GPT-4.5 Turbo: ~$0.001 за 1000 токенов (в 30 раз дешевле)

- Claude 4.5: ~$0.003–0.015 в зависимости от версии

Как оптимизировать расходы:

- Используйте более дешёвые модели для простых задач (например, GPT-3.5 для черновиков, GPT-4 — только для финальной генерации).

- Сокращайте длину промптов: убирайте избыточные инструкции, которые не влияют на результат.

- Кешируйте частые запросы: если промпт генерирует типовой ответ, сохраните его и переиспользуйте.

- Устанавливайте лимиты на длину ответа (параметр max_tokens), чтобы модель не генерировала лишний текст.

Для production-систем с высокой нагрузкой рекомендуется вести детальный учёт расходов и оптимизировать промпты каждые 1–2 месяца.

▸Сколько времени занимает полный цикл разработки промпта от идеи до production?

Время зависит от сложности задачи и зрелости команды. Вот типичные сроки для разных сценариев:

Простой промпт (генерация короткого текста, стандартный формат):

- Анализ задачи: 1–2 часа

- Черновик: 30 минут

- Тестирование: 1–2 часа

- Интеграция: 2–4 часа

- Итого: 1–2 рабочих дня

Сложный промпт (Chain of Thought, интеграция с базами данных, требования к безопасности):

- Анализ задачи: 1–2 дня

- Черновик и ревизия: 1–2 дня

- Тестирование: 3–5 дней

- Интеграция и настройка: 3–7 дней

- Итого: 2–3 недели

Команды, которые используют готовые библиотеки и шаблоны, сокращают время разработки на 40–60%. Первые промпты всегда занимают больше времени, но с накоплением опыта процесс ускоряется.

▸Какие роли должны быть в команде для эффективного управления промптами?

Для системной работы с промптами рекомендуется распределить следующие роли:

Промпт-инженер (автор): создаёт и дорабатывает промпты, тестирует их, адаптирует под изменения модели. Должен знать основы промпт-инжиниринга и понимать специфику бизнес-задачи.

Ревьюер: проверяет качество результатов, выявляет отклонения и проблемы. Может быть экспертом в предметной области (маркетолог для маркетинговых промптов, аналитик для аналитических).

Владелец процесса (менеджер): координирует работу, принимает решения об обновлениях, управляет библиотекой промптов и приоритизирует задачи.

Технический специалист (DevOps/Backend): интегрирует промпты в production-системы, настраивает мониторинг, управляет версиями через API.

В небольших командах один человек может совмещать несколько ролей. В крупных организациях это отдельные позиции, что обеспечивает более высокое качество и надёжность систем.

▸Как часто нужно обновлять промпты в production?

Частота обновлений зависит от стабильности модели и критичности процесса. Вот базовые рекомендации:

Регулярный мониторинг: еженедельная выборочная проверка качества результатов (20–30 случайных примеров). Это помогает выявить проблемы до того, как они повлияют на бизнес.

Плановые обновления: раз в 2–3 месяца пересматривайте все активные промпты, даже если они работают стабильно. Модели обновляются, появляются новые техники, меняются бизнес-требования.

Внеплановые обновления: немедленно, если обнаружены критические ошибки (галлюцинации, утечки данных, некорректный формат) или после обновления модели провайдером.

Архивация: промпты, которые не использовались 6+ месяцев, переводите в архив с сохранением истории. Это упрощает навигацию в библиотеке.

Оптимальная стратегия — сочетание регулярного мониторинга с гибкостью для внеплановых правок. Команды, которые игнорируют обновления, рискуют столкнуться с деградацией качества через 3–6 месяцев после запуска.

▸С чего начать внедрение lifecycle-подхода в команде, которая никогда этого не делала?

Пошаговый план внедрения для команд-новичков:

- Аудит текущих промптов: соберите все промпты, которые используются в работе (даже те, что хранятся в личных заметках). Оцените, сколько их и для каких задач.

- Выберите пилотный проект: возьмите один критичный промпт (например, для генерации коммерческих предложений) и проведите его через полный lifecycle: черновик → тест → production → мониторинг.

- Создайте минимальную библиотеку: заведите общий документ или простой сервис (BestpromptAI, Notion, даже Google Docs) для хранения промптов с тегами и статусами.

- Назначьте ответственных: определите, кто будет автором, кто ревьюером, кто владельцем процесса. Пусть это будет неформально, но зафиксировано.

- Запустите регулярные ревью: раз в месяц проводите 30-минутную встречу команды, где обсуждаете результаты, проблемы и улучшения.

Главное — начать с малого. Не пытайтесь сразу внедрить все этапы lifecycle. Даже базовое версионирование и тестирование дадут результат уже через 2–3 недели.