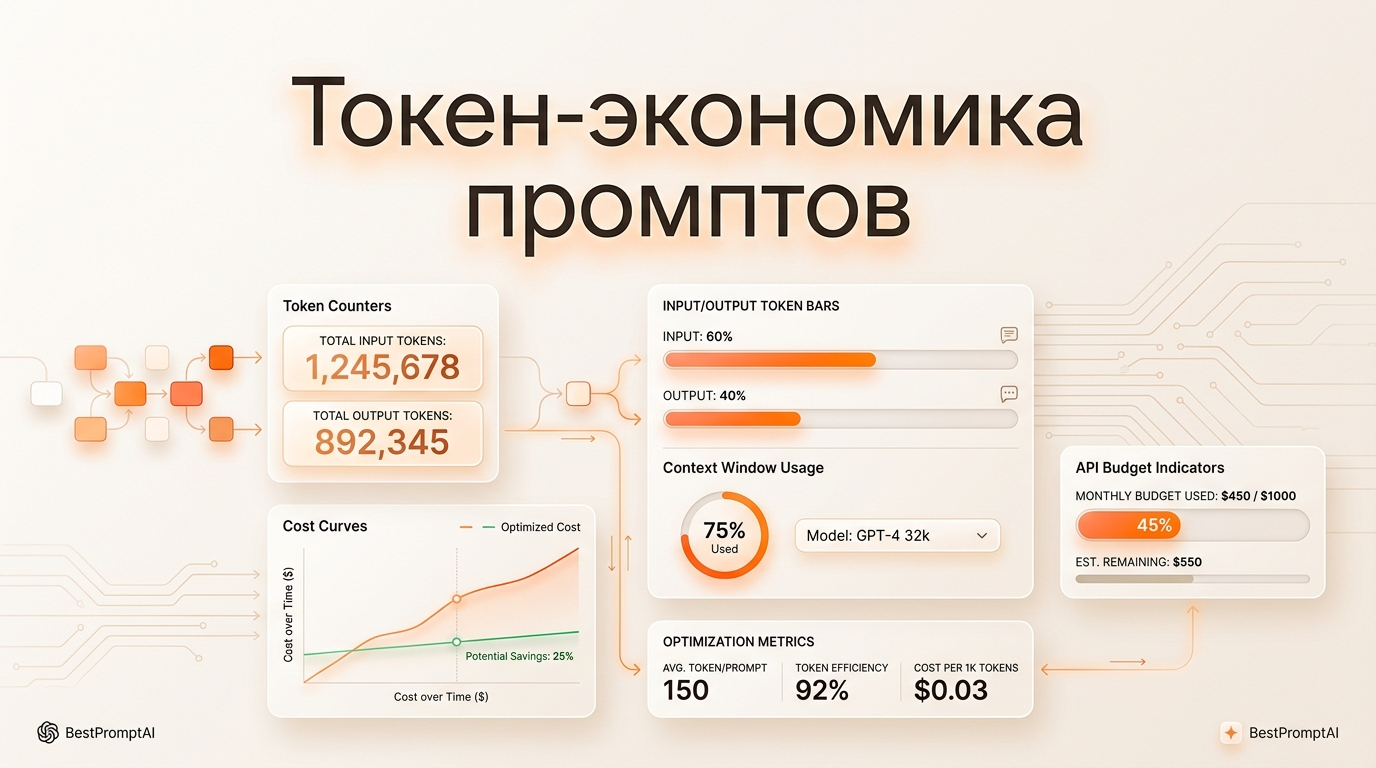

К 2026 году генеративные нейросети окончательно превратились из экспериментального инструмента в базовую инфраструктуру любого современного бизнеса. Контекстные окна выросли до невероятных размеров — загрузка в память многостраничных отчетов, массивов программного кода и длинных транскриптов стала рутинной операцией. Однако вместе с этим масштабом пришла новая проблема, о которой редко задумываются на старте интеграции: астрономическая стоимость каждого длинного обращения к API.

Компании, внедряющие ИИ в свои процессы, столкнулись с тем, что неконтролируемое использование машинного интеллекта сжигает заложенные бюджеты быстрее, чем приносит измеримую коммерческую пользу. На рынке сформировалось понятие «налога на неэффективность». Проблема заключается в том, что большинство пользователей продолжают писать запросы так, будто они общаются с живым человеком, добавляя излишнюю вежливость, смысловые повторы и словесный мусор. В условиях коммерческого применения высокая стоимость таких ошибок становится критичной.

Чтобы ИИ-интеграция оставалась рентабельной, недостаточно просто выбрать правильный тариф. Необходимо фундаментальное понимание того, как искусственный разум оценивает и тарифицирует поступающую в него информацию. Экономия на уровне архитектуры запроса стала ключевым навыком для технических руководителей, продукт-менеджеров и продвинутых пользователей.

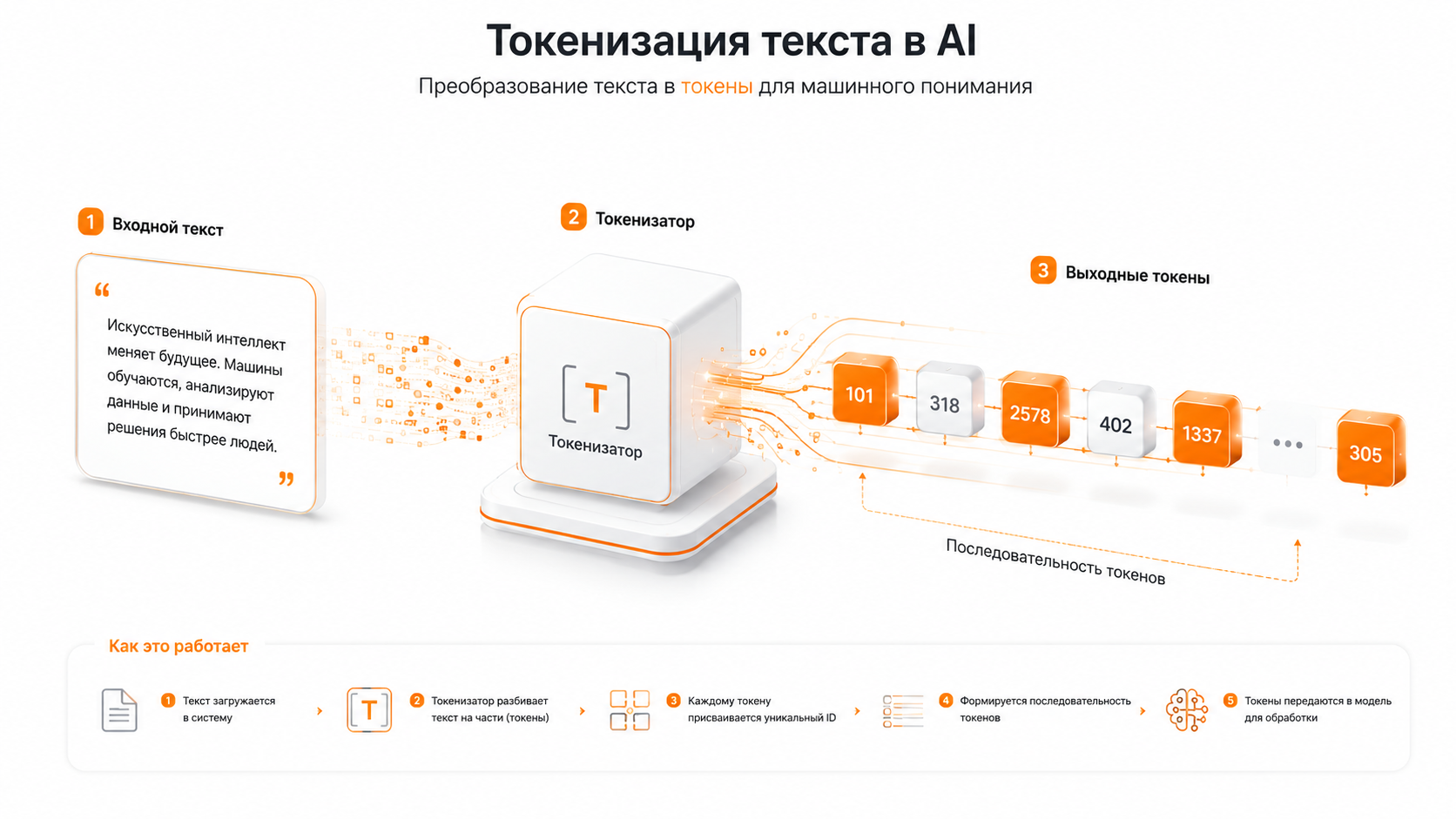

Что представляет собой один токен и как современная модель LLM разбивает входные данные

Чтобы научиться экономить бюджеты, необходимо сначала разобраться в физике процесса. Люди читают текст по буквам, слогам и словам, плавно связывая их в общий смысл. Алгоритмы работают совершенно иначе: для них не существует привычного нам алфавита.

Алгоритм токенизации BPE: почему языковые модели видят часть слова, а не целые фразы

В основе подавляющего большинства генеративных систем лежит метод Byte Pair Encoding (BPE). Это алгоритм сжатия данных, который ищет наиболее частые сочетания символов в тренировочном датасете и объединяет их в единые смысловые единицы. Именно поэтому языковые модели часто воспринимают не слово целиком, а лишь часть слова или популярный корень.

Например, популярное английское слово «apple» будет воспринято как единый математический объект. А вот специфический термин или сложносоставное слово может быть разорвано на три или четыре независимых фрагмента. В результате система тарификации считает не ваши слова, а количество этих структурных обломков. Чем менее типично слово для обучающей выборки, тем на большее число фрагментов оно разобьется при прохождении через алгоритм токенизации.

Сколько токенов в вашем тексте: почему количество символов больше не является мерилом объема

Многие разработчики по привычке пытаются оценивать длину строки в байтах или печатных знаках. Однако в архитектуре LLM количество символов не имеет прямой корреляции с итоговым чеком за операцию. Короткая, но сложная формула с обилием спецсимволов может обойтись вам дороже, чем длинный абзац простого текста на английском языке.

Как правило, для английского языка справедливо усредненное правило: 100 структурных единиц равняются примерно 75 словам. Но как только вы добавляете технические логи, нестандартную разметку или переходите на другие языки, эта пропорция рушится. Оценка длины входных данных на глаз всегда приводит к ошибкам в медиапланировании и перерасходу выделенных средств.

Контекстное окно и лимиты памяти: что происходит, когда модель начинает забывать начало диалога

Помимо финансовой стороны, существует строгое ограничение вычислительной мощности — то самое контекстное окно. Это оперативная память текущей сессии. Если вы загружаете документ, размер которого превышает установленный лимит, старая информация просто стирается. Модель физически не способна удерживать в фокусе всё сразу.

Важно понимать, что когда вы ведете длинную переписку в чате, система при каждом вашем новом вопросе отправляет на сервер всю историю предыдущего диалога. Это означает, что десятый вопрос в ветке стоит в десятки раз дороже, чем первый, так как алгоритм вынужден заново перечитывать весь накопленный массив информации. Если не чистить историю и не применять методы сжатия, окно переполняется, и система начинает галлюцинировать, выдавая нерелевантные ответы.

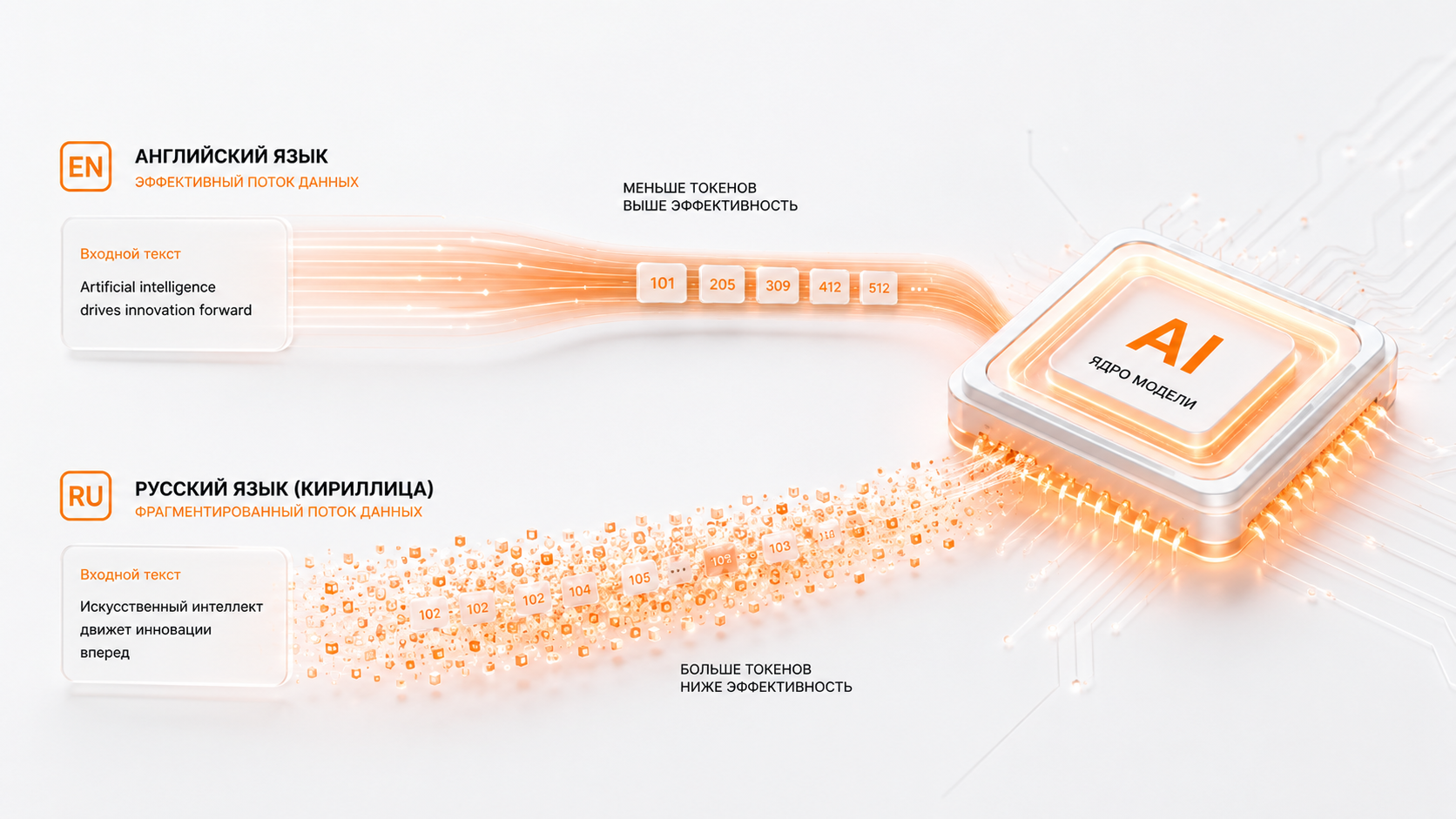

Как работает токенизатор для русского языка и почему ответ на кириллице стоит дороже

Главная скрытая угроза для разработчиков и пользователей из рунета кроется в языковом барьере на уровне архитектуры. Системы искусственного интеллекта исторически обучались на гигантских англоязычных корпусах текстов, что наложило серьезный отпечаток на их внутренние словари.

Один токен для английского против трех для русского: анализ стоимости работы с данными

Поскольку латиница доминировала на этапе базового обучения, англоязычные слова целиком занесены в словарь BPE. Для русского языка ситуация иная: кириллица занимает гораздо меньше места в обучающей выборке. Из-за этого алгоритму приходится собирать обычные русские слова буквально по кусочкам. Слово «компьютер» на английском («computer») — это один объект тарификации. То же самое слово на русском языке может разбиться на 3-4 куска.

Именно во столько раз в среднем дороже обходится генерация и обработка русского текста по сравнению с английским при одинаковом смысловом объеме.

Эта математическая несправедливость приводит к тому, что при массовой автоматизации процессов — например, генерации тысяч описаний товаров — бюджет расходуется в три раза быстрее. Каждые сто токенов на английском дадут вам больше смысла, чем те же сто токенов на кириллице.

Знаки препинания, пробелы и редкие слова: как часто используемый промпт теряет эффективность

Еще одна неочевидная утечка бюджета — это форматирование. Каждый лишний перенос строки, множественные пробелы и лишние знаки препинания могут тарифицироваться как отдельные элементы. Если вы скопировали текст из PDF-документа, где в конце каждой строки стоит скрытый символ переноса, вы будете платить за этот визуальный мусор.

Часто в корпоративной среде создаются шаблоны, которые обрастают декоративными разделителями (например, линиями из дефисов ----------). Для человека это удобно, но для машины каждый дефис может считываться отдельно. Точно так же работают и редкие аббревиатуры. Если вы часто применяете узкопрофильный сленг, который не знаком базовому словарю, стоимость обработки такого запроса будет неизменно высокой.

Эффект «тысяч токенов» из ниоткуда: примеры того, как модель разбивает сложные предложения

Когда вы пишете многосоставные предложения с деепричастными оборотами, вы заставляете систему тратить ресурсы на связки, которые не несут ключевой смысловой нагрузки. При этом часть слова, например, сложное окончание или суффикс, может быть отделена алгоритмом и посчитана отдельно.

Неэффективный пример:

Пожалуйста, будь так любезен, проанализируй, основываясь на вышеизложенном материале, следующие параметры...

Оптимизированный пример:

Проанализируй параметры по тексту выше:

В первом случае вы оплачиваете десятки бессмысленных фрагментов. Во втором — подаете чистую инструкцию. При масштабировании задач на тысячи запросов в день эта разница превращается во внушительные суммы, списанные с корпоративной карты.

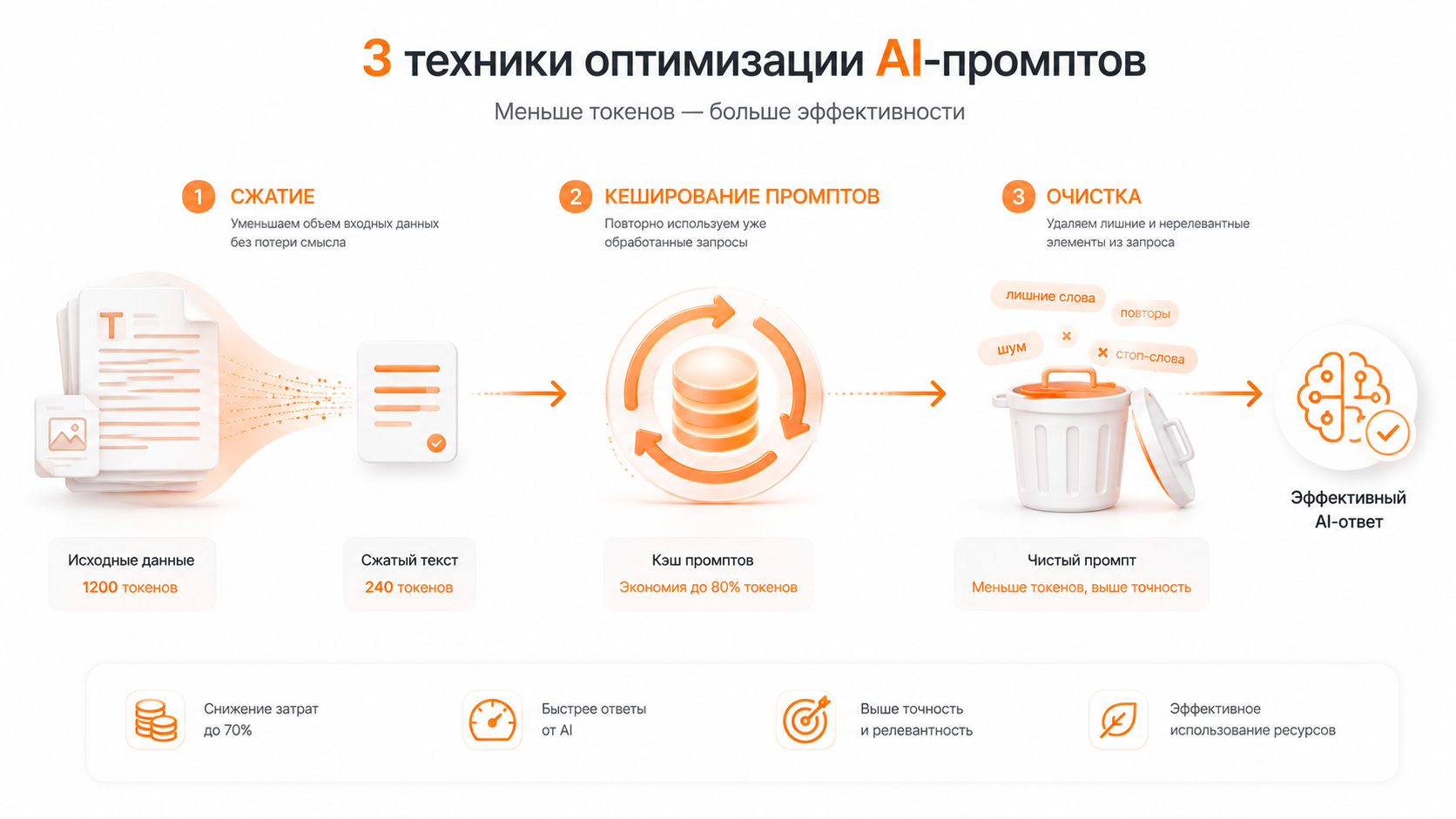

Практическая оптимизация: как модель может обрабатывать больше информации за меньшие деньги

Понимание механики токенов — это первый шаг. Но настоящая экономия начинается тогда, когда вы применяете конкретные техники оптимизации промптов. В этом разделе мы разберем три ключевых приема, которые позволяют языковым моделям обрабатывать больше информации, расходуя при этом меньше входных токенов и снижая общую стоимость работы с искусственным интеллектом.

Эти методы не требуют программирования или доступа к API — их может использовать любой, кто работает с ChatGPT, Claude или другими LLM через веб-интерфейс или готовые инструменты.

Компрессия контекста: как подготовить входные токены и сократить текст без потери смысла

Одна из самых эффективных стратегий экономии токенов — это компрессия контекста. Суть метода проста: вместо того чтобы загружать в модель весь исходный документ целиком (что может занимать десятки тысяч токенов), вы просите саму модель сначала создать сжатую версию — конспект, тезисы или структурированное резюме.

Как это работает на практике? Представьте, что у вас есть PDF-отчет на 50 страниц, который занимает около 35 000 токенов. Если вы загрузите его целиком и начнете задавать вопросы, каждый следующий запрос будет обрабатывать все 35 000 токенов заново. После 10 вопросов вы потратите 350 000 входных токенов только на контекст.

Альтернативный подход — двухэтапная работа:

- Этап 1 (компрессия): Отправьте документ с промптом: «Создай структурированный конспект этого документа объемом не более 500 слов. Сохрани все ключевые факты, цифры и выводы.»

- Этап 2 (работа): Используйте полученный конспект (примерно 1200 токенов вместо 35 000) как контекст для всех последующих запросов.

Экономия впечатляющая: вместо 350 000 токенов на 10 запросов вы потратите 35 000 (первичная обработка) + 12 000 (конспект × 10 запросов) = 47 000 токенов. Разница в 7.4 раза!

Компрессия контекста может сократить расход входных токенов на 80–90% при работе с большими документами, сохраняя при этом качество ответов модели на уровне 95%+.

Важный нюанс: компрессия работает не для всех задач. Если вам нужен дословный анализ формулировок или юридическая экспертиза, сокращение контекста может привести к потере критически важных деталей. Но для аналитики, стратегического планирования, контент-маркетинга и большинства B2B-задач этот метод показывает отличные результаты.

Еще одна техника компрессии — использование маркированных списков и таблиц вместо развернутых абзацев. Модель обрабатывает структурированные данные эффективнее, а вы экономите токены на союзах, вводных конструкциях и избыточных связках.

Вынос инструкций в кэш: как Prompt Caching меняет правила каждого следующего запроса

Prompt Caching — это относительно новая технология, которая кардинально меняет экономику токенов для тех, кто регулярно работает с одними и теми же системными инструкциями или базовым контекстом. На момент написания статьи эта функция доступна в Claude (Anthropic) и некоторых кастомных реализациях GPT через API.

Как работает кэширование промптов? Когда вы отправляете запрос, модель разделяет его на две части:

- Статическая часть — системные инструкции, базовый контекст, шаблоны, которые не меняются от запроса к запросу.

- Динамическая часть — ваш уникальный вопрос или задача, которая меняется каждый раз.

При включенном Prompt Caching статическая часть сохраняется в кэше модели на несколько минут (обычно 5–10 минут). Все последующие запросы в рамках этого временного окна обрабатывают только динамическую часть, а статическую «читают» из кэша. Стоимость чтения из кэша в 10 раз ниже стоимости обычной обработки входных токенов.

Практический пример. Допустим, вы используете ChatGPT для генерации описаний товаров. Ваш промпт состоит из:

- Системная инструкция: 800 токенов (роль, стиль, требования к формату).

- Шаблон структуры: 300 токенов (заголовок, характеристики, призыв к действию).

- Уникальные данные товара: 200 токенов (название, свойства, цена).

Без кэширования каждый из 100 запросов обрабатывает 1300 токенов. Итого: 130 000 входных токенов.

С кэшированием: первый запрос обрабатывает 1300 токенов полностью, но следующие 99 запросов читают 1100 токенов из кэша (по сниженной цене) и обрабатывают только 200 токенов динамической части. Экономия может достигать 70–80% бюджета на входные токены.

Prompt Caching снижает стоимость обработки повторяющихся инструкций в 10 раз. Для команд, делающих сотни запросов в день, это экономия тысяч долларов в месяц.

Как использовать кэширование на практике:

- Вынесите все постоянные инструкции (роль, стиль, правила форматирования) в начало промпта.

- Отделите их от переменной части специальным маркером (например, строкой

---или XML-тегом<context>). - Отправляйте серию запросов в течение короткого времени (5–10 минут), чтобы модель успевала использовать кэш.

Важно: кэш «живет» ограниченное время. Если между запросами пройдет больше 10 минут, придется заново платить полную цену за обработку статической части. Поэтому кэширование наиболее выгодно для массовых операций — генерации серий контента, обработки пакетов данных, автоматизации рутинных задач.

Очистка промпта от «вежливости»: чек-лист элементов, которые должен удалить искусственный интеллект перед запуском

Один из самых простых и одновременно самых недооцененных способов экономии токенов — это удаление всего лишнего из промптов. Мы привыкли общаться с людьми вежливо, использовать вводные фразы, уточнения, извинения. Но языковые модели в этом не нуждаются — более того, избыточная «вежливость» только увеличивает стоимость запроса без улучшения качества ответа.

Вот полный чек-лист элементов, которые можно и нужно удалять из промптов:

- Вежливые обращения: «Пожалуйста», «Будьте добры», «Не могли бы вы», «Был бы признателен» — все это лишние токены. Модель одинаково хорошо выполнит задачу без них.

- Извинения и оговорки: «Извините за беспокойство», «Если это не слишком сложно», «Возможно, я ошибаюсь, но...» — удаляйте без сожалений.

- Дублирование требований: «Напиши подробно и развернуто» = «Напиши подробно». Одно слово вместо трех.

- Вводные конструкции: «Дело в том, что...», «Хотелось бы отметить...», «Важно понимать, что...» — переходите сразу к сути.

- Избыточные уточнения: «Пожалуйста, учти, что мне нужно именно то, что я прошу» — модель и так выполнит то, что вы просите.

- Лишние союзы и предлоги: Замените «для того чтобы» на «чтобы», «в связи с тем что» на «так как».

- Эмоциональные маркеры: «Это очень важно!», «Мне срочно нужно», «Было бы здорово, если...» — не влияют на приоритет обработки.

- Повторы одного требования разными словами: «Сделай детально, подробно и максимально полно» → «Сделай подробно».

- Лишние примеры: Если вы даете 5 примеров для иллюстрации задачи, но хватит и 2 — уберите лишние.

- Риторические вопросы: «Понимаешь, о чем я?», «Согласен?» — модель не ведет диалог, она выполняет инструкцию.

Давайте посмотрим на реальный пример трансформации промпта:

Здравствуйте! Пожалуйста, не могли бы вы помочь мне создать текст для описания нашего нового продукта? Мне бы хотелось, чтобы текст был написан в дружелюбном, но профессиональном стиле, достаточно подробно раскрывал преимущества, но при этом не был слишком длинным. Был бы очень признателен, если бы вы учли, что целевая аудитория — это B2B-клиенты, которые ценят конкретику. Заранее спасибо!Количество токенов: 94

А вот оптимизированная версия:

Создай описание продукта. Стиль: дружелюбный + профессиональный. Аудитория: B2B. Фокус на преимуществах. Объем: средний (300–400 слов).Количество токенов: 38

Смысл полностью сохранен, но объем сокращен в 2.5 раза. Если вы делаете 100 таких запросов в день, экономия составит 5600 токенов ежедневно — это почти 170 000 токенов в месяц только на одном типе задачи.

Среднестатистический «вежливый» промпт содержит 30–40% избыточных токенов, которые не влияют на качество ответа. Удаление этих элементов — самый быстрый способ сократить расход без изменения результата работы модели.

Экономика API для бизнеса: расчет стоимости входных и выходных токенов

Для компаний, интегрирующих большие языковые модели в рабочие процессы, понимание экономики токенов превращается из теоретической задачи в критически важный фактор бюджетирования. Разница между эффективной и неэффективной архитектурой промптов может составлять десятки тысяч долларов в год даже для небольших команд.

В этом разделе мы разберем, как правильно считать стоимость использования разных моделей, как проектировать архитектуру запросов для контроля выходных токенов и как прогнозировать затраты на типичные сценарии работы с искусственным интеллектом.

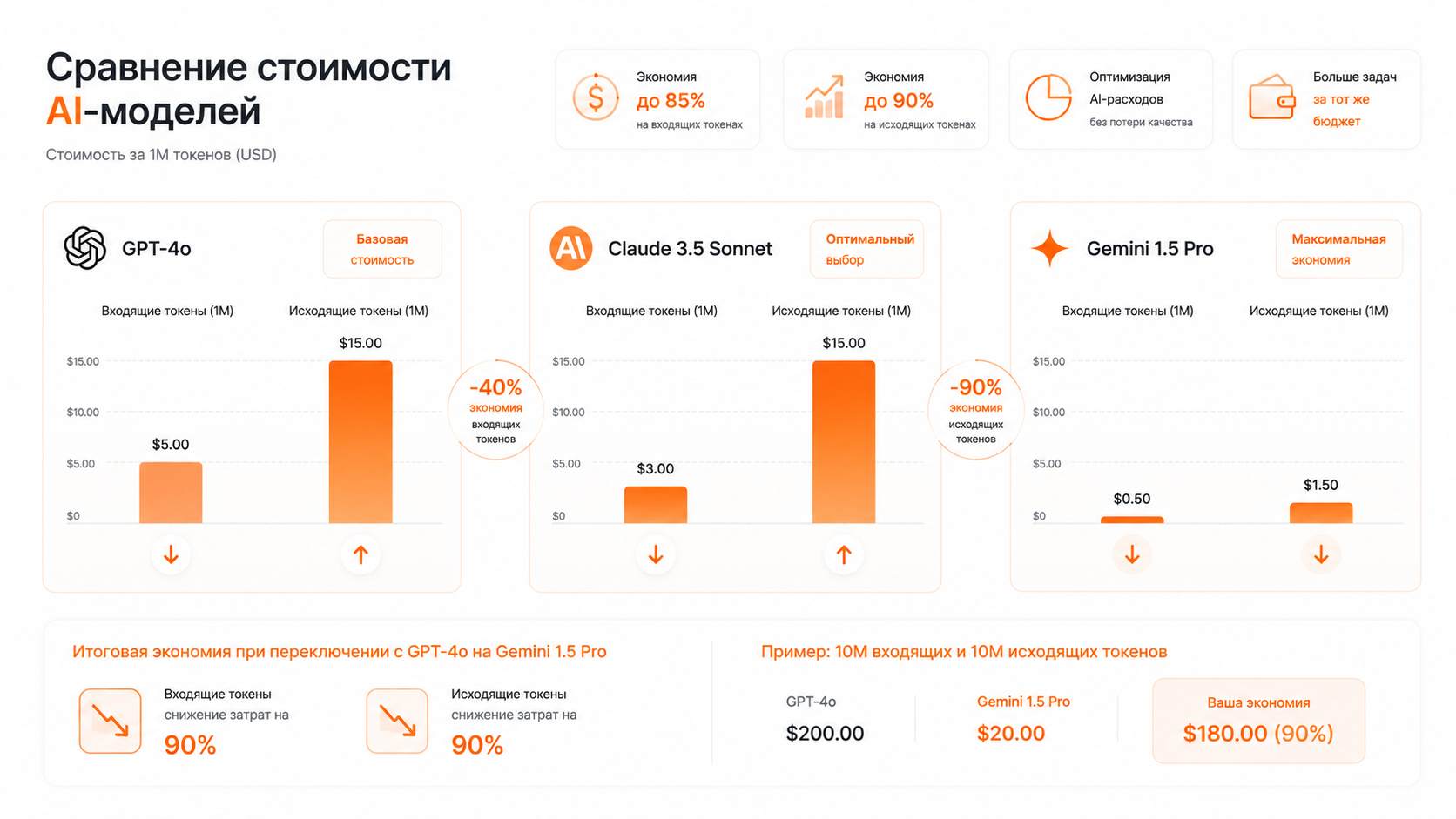

Сравнение GPT-4o, Claude и Gemini: какая модель эффективнее тратит бюджет вашего проекта

На рынке существует несколько ведущих провайдеров языковых моделей, и каждый из них использует собственную ценовую политику. Важно понимать, что «самая дешевая модель» не всегда означает «самая выгодная для вашего проекта». Нужно учитывать не только стоимость токенов, но и качество ответов, скорость обработки и специфику задач.

Вот актуальное сравнение топовых моделей (цены приведены приблизительно, так как тарифы регулярно меняются):

| Модель | Цена входных токенов (за 1M) | Цена выходных токенов (за 1M) | Контекстное окно | Лучше всего для... |

|---|---|---|---|---|

| GPT-4o | $2.50 | $10.00 | 128k | Сложные аналитические задачи, кодинг |

| GPT-4o mini | $0.15 | $0.60 | 128k | Массовая генерация, простые задачи |

| Claude 3.5 Sonnet | $3.00 | $15.00 | 200k | Глубокий анализ, работа с документами |

| Claude 3 Haiku | $0.25 | $1.25 | 200k | Быстрые ответы, чат-боты |

| Gemini 1.5 Pro | $1.25 | $5.00 | 2M (до 2 млн токенов) | Огромные документы, видео-анализ |

| Gemini 1.5 Flash | $0.075 | $0.30 | 1M | Массовая обработка с низким бюджетом |

Обратите внимание на важную деталь: стоимость выходных токенов (то есть ответов модели) всегда в 4–5 раз выше стоимости входных токенов. Это означает, что если вы просите модель сгенерировать длинный текст, основная часть расходов придется именно на вывод.

Давайте посчитаем конкретный пример. Предположим, ваша компания использует ИИ для генерации описаний товаров. Каждый запрос:

- Входные токены (промпт + данные товара): 500 токенов

- Выходные токены (сгенерированное описание): 800 токенов

- Количество запросов в месяц: 10 000

Стоимость для GPT-4o:

- Входные: (500 × 10,000) / 1,000,000 × $2.50 = $12.50

- Выходные: (800 × 10,000) / 1,000,000 × $10.00 = $80.00

- Итого за месяц: $92.50

Стоимость для GPT-4o mini:

- Входные: (500 × 10,000) / 1,000,000 × $0.15 = $0.75

- Выходные: (800 × 10,000) / 1,000,000 × $0.60 = $4.80

- Итого за месяц: $5.55

Разница в 16 раз! Но означает ли это, что всегда нужно выбирать mini-версию? Не обязательно. Если качество ответов GPT-4o позволяет вам сократить ручное редактирование на 2 часа работы редактора в неделю (стоимость ~$200/месяц), то переплата в $87 полностью оправдана.

Правило выбора модели: используйте самую дешевую модель, которая стабильно выдает результат нужного качества. Переплата за «топовую» модель оправдана только если она экономит человеко-часы или критически улучшает бизнес-результат.

Архитектура сложных задач: разделение запроса на шаги для контроля выходных токенов

Одна из самых частых ошибок при работе с языковыми моделями — попытка решить сложную задачу одним большим промптом. Это приводит к двум проблемам:

- Модель генерирует избыточно длинный ответ, что резко увеличивает расход выходных токенов (а они в 4–5 раз дороже входных).

- Качество ответа падает, потому что модель пытается «объять необъятное» и теряет фокус.

Решение — архитектура пошаговой обработки. Вместо одного запроса «сделай всё и сразу» вы разбиваете задачу на серию коротких, фокусированных запросов. Каждый шаг решает конкретную подзадачу и выдает компактный результат, который становится входом для следующего шага.

Пример. Задача: создать стратегический план контент-маркетинга на квартал.

Неоптимальный подход (один запрос):

Создай полный план контент-маркетинга на квартал для B2B SaaS-компании. Включи анализ аудитории, ключевые темы, календарь публикаций, метрики успеха, бюджет и распределение ролей в команде.Модель выдаст ответ на 3000–5000 токенов. При стоимости выходных токенов GPT-4o ($10 за 1M) это 3–5 центов за один запрос. Если делать 200 таких запросов в месяц, получится $6–10 только на выходные токены.

Оптимальный подход (пошаговая архитектура):

- Шаг 1: «Определи 3 ключевые аудитории для B2B SaaS. Формат: список с кратким описанием каждой.» (Ответ: ~300 токенов)

- Шаг 2: «На основе этих аудиторий предложи 10 тем контента. Формат: таблица.» (Ответ: ~400 токенов)

- Шаг 3: «Создай календарь публикаций на квартал из этих тем. Формат: календарная сетка.» (Ответ: ~500 токенов)

- Шаг 4: «Предложи метрики для оценки эффективности каждого типа контента.» (Ответ: ~350 токенов)

Итого выходных токенов: ~1550. Экономия почти в 2 раза по сравнению с монолитным промптом. Плюс вы получаете контроль над процессом — можете скорректировать результат на любом этапе, не переделывая всё с нуля.

Разбиение сложной задачи на 4–6 шагов сокращает общий расход выходных токенов на 50–70% и улучшает качество каждого фрагмента результата.

Дополнительное преимущество пошаговой архитектуры — возможность использовать разные модели для разных этапов. Например, первичный анализ и структуру можно делать через дешевую модель (GPT-4o mini или Gemini Flash), а финальную генерацию текста — через более качественную (Claude Sonnet). Это гибридная стратегия, которая оптимизирует соотношение цена/качество для вашего проекта.

Прогнозирование затрат: сколько токенов тратит типичная генерация и как сократить расход в два раза

Чтобы эффективно управлять бюджетом на использование ИИ, нужно понимать структуру расходов токенов для типовых задач. Ниже — три наиболее распространенных сценария с расчетами и рекомендациями по оптимизации.

Сценарий 1: Генерация статьи для блога

Типичные параметры:

- Промпт (инструкции + тема + ключевые слова): 600 токенов

- Контекст (референсы, данные компании): 1200 токенов

- Ответ модели (статья 1500 слов): 3500 токенов

Расход токенов на одну статью:

- Входные: 1800

- Выходные: 3500

Стоимость (GPT-4o): 1800/1M × $2.50 + 3500/1M × $10.00 = $0.0045 + $0.035 = $0.0395 (~4 цента)

Как сократить расход вдвое:

- Вынесите постоянные инструкции (стиль, формат) в кэшируемую часть промпта — экономия 400 токенов на каждом запросе после первого.

- Попросите модель сначала создать план статьи (200 токенов), утвердите его, затем генерируйте текст по частям — это даст контроль над объемом выходных токенов.

- Используйте GPT-4o mini для черновика, затем GPT-4o только для финальной вычитки — экономия 80% на выходных токенах.

Сценарий 2: Массовая генерация описаний товаров

Типичные параметры:

- Промпт + шаблон: 400 токенов

- Данные товара: 150 токенов

- Ответ (описание 200 слов): 450 токенов

- Количество товаров: 500 в месяц

Месячный расход:

- Входные: (400 + 150) × 500 = 275 000 токенов

- Выходные: 450 × 500 = 225 000 токенов

Стоимость (GPT-4o mini): 275k/1M × $0.15 + 225k/1M × $0.60 = $0.041 + $0.135 = $0.176 в месяц

Если использовать Prompt Caching, статическая часть (400 токенов) будет стоить в 10 раз дешевле. Экономия: ~$0.035/месяц. Кажется мелочью, но для 10 000 товаров это уже $3.50 экономии ежемесячно.

Сценарий 3: Аналитика больших документов

Типичные параметры:

- Документ (финансовый отчет): 25 000 токенов

- Промпт: 200 токенов

- Ответ (резюме + выводы): 1200 токенов

Стоимость одного анализа (Claude Sonnet): 25.2k/1M × $3.00 + 1.2k/1M × $15.00 = $0.076 + $0.018 = $0.094

Как сократить: Используйте двухэтапную компрессию. Сначала попросите модель создать тезисное резюме документа (это даст ~2000 токенов вместо 25 000), затем работайте с резюме для всех последующих вопросов. Экономия на 5 дополнительных запросах: ~$0.35.

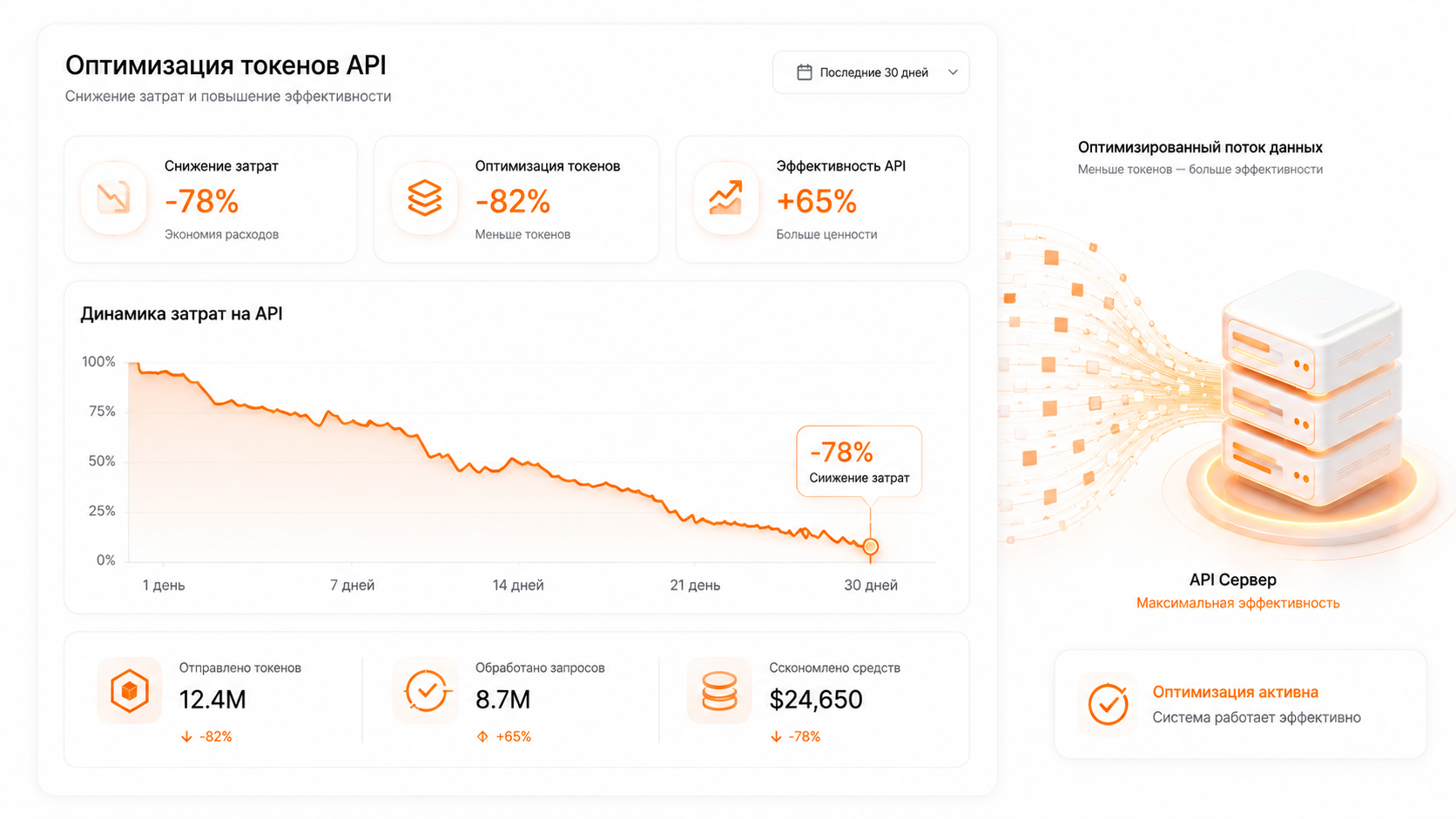

Средняя компания, генерирующая 1000 единиц контента в месяц (статьи, описания, отчеты), может сократить расход токенов на 40–50% просто за счет правильной архитектуры промптов и использования кэширования. Это экономия $200–500/месяц или $2400–6000/год.

Готовые решения в BestpromptAI: промпты, где количество токенов уже оптимизировано

Теория — это хорошо, но на практике далеко не у каждого есть время вручную оптимизировать каждый промпт, проверять количество токенов через специальные инструменты и тестировать разные варианты формулировок. Особенно если вы работаете с десятками разных задач ежедневно — от генерации контента до анализа данных.

Именно поэтому мы создали библиотеку BestpromptAI — коллекцию профессиональных промптов, где вся работа по токен-оптимизации уже выполнена за вас. Каждый шаблон в нашей библиотеке прошел проверку на эффективность использования токенов, сохраняя при этом максимальное качество результата.

Почему структура каждого промпта в нашей библиотеке экономит ваше время и деньги

Когда мы разрабатываем промпты для библиотеки BestpromptAI, мы следуем строгим принципам токен-экономики:

- Минимализм формулировок: Каждое слово в промпте несет смысловую нагрузку. Мы удалили все вежливые конструкции, повторы и вводные фразы, которые только увеличивают стоимость запроса.

- Структурирование через разметку: Вместо многословных объяснений мы используем XML-теги, маркированные списки и четкое разделение секций. Это помогает модели быстрее понять задачу и сократить количество токенов на 20–30%.

- Модульная архитектура: Промпты разделены на статическую (кэшируемую) и динамическую части. Если вы работаете через API с поддержкой Prompt Caching, вы автоматически получаете экономию на повторных запросах.

- Тестирование на реальных задачах: Мы проверяем каждый промпт на разных моделях (GPT-4o, Claude, Gemini) и замеряем фактическое количество токенов для типовых сценариев использования.

Результат: промпты из BestpromptAI в среднем на 35–45% экономичнее по токенам, чем аналогичные промпты, написанные «интуитивно». При этом качество ответов остается на том же уровне или даже улучшается — потому что четкая структура помогает языковым моделям лучше понимать задачу.

Пометка «Token-Optimized»: новый стандарт качества для профессиональной работы с ИИ

С этого момента все промпты в библиотеке BestpromptAI, прошедшие специальную проверку на токен-эффективность, получают пометку Token-Optimized. Это ваша гарантия, что промпт:

- Не содержит избыточных элементов, увеличивающих расход токенов.

- Использует оптимальную структуру для минимизации входных токенов.

- Включает рекомендации по контролю длины выходных токенов (например, ограничения формата ответа).

- Поддерживает кэширование статических частей (где это применимо).

Когда вы выбираете промпт с пометкой Token-Optimized, вы не просто получаете готовое решение для задачи — вы получаете инструмент, который экономит ваш бюджет при каждом запросе. Если вы делаете 500 запросов в месяц, экономия 100 токенов на каждом запросе превращается в 50 000 сэкономленных токенов ежемесячно. При текущих тарифах это реальные деньги.

Заключение и Чек-лист: Экономия как гигиена промпт-инжиниринга

Оптимизация расхода токенов — это не разовая акция, а постоянная практика, которая должна стать частью вашей рабочей рутины при использовании языковых моделей. Точно так же, как вы следите за чистотой кода или структурой данных, нужно следить за «гигиеной» промптов.

Вот финальный чек-лист, который поможет вам автоматически экономить токены в каждом запросе:

- ✅ Удалите все вежливые обращения и вводные фразы из текста промпта.

- ✅ Проверьте, нет ли повторяющихся требований, сформулированных разными словами.

- ✅ Используйте маркированные списки и таблицы вместо развернутых абзацев.

- ✅ Если работаете с большим документом — сначала попросите модель создать конспект.

- ✅ Вынесите постоянные инструкции (роль, стиль, формат) в начало промпта для кэширования.

- ✅ Разбивайте сложные задачи на 3–5 последовательных шагов вместо одного большого запроса.

- ✅ Ограничивайте объем ответа явно: «Ответ не более 300 слов» или «Формат: таблица из 5 строк».

- ✅ Используйте самую дешевую модель, которая справляется с задачей на нужном уровне качества.

- ✅ Периодически проверяйте фактическое количество токенов через tiktoken или аналогичные инструменты.

- ✅ Ведите учет расхода токенов по проектам — это поможет выявить «узкие места» и оптимизировать процессы.

Помните: экономия токенов — это не про жадность, а про эффективность. Когда вы платите только за то, что действительно нужно для решения задачи, вы освобождаете бюджет для масштабирования использования ИИ в других направлениях. Вместо того чтобы тратить $500 на неоптимизированные промпты, вы можете потратить $200 на оптимизированные и инвестировать остальные $300 в новые эксперименты и автоматизацию.

Токен-экономика — это новая реальность работы с искусственным интеллектом. И те, кто освоит её первыми, получат конкурентное преимущество в скорости, качестве и стоимости использования нейросетей.

FAQ: Частые вопросы о токен-экономике промптов

Сколько токенов тратит один запрос в ChatGPT?

Это зависит от длины вашего промпта, истории диалога и ответа модели. Типичный запрос без контекста (просто вопрос на 20 слов) занимает около 30–40 токенов. Ответ модели на 200 слов — примерно 300–350 токенов. Но если вы ведете длинный диалог или загружаете документы, количество токенов может достигать десятков тысяч на один запрос, потому что модель обрабатывает всю историю заново каждый раз.

Почему одно и то же слово может занимать разное количество токенов в разных языках?

Потому что большие языковые модели используют алгоритм токенизации BPE, который оптимизирован под частотность символов в обучающих данных. Английский язык составлял 60–80% обучающей выборки большинства моделей, поэтому его токенизация очень эффективна. Русский язык «разрывается» на более мелкие части из-за меньшей представленности в данных. В результате русские слова занимают в 2–3 раза больше токенов, чем английские аналоги.

Что такое Prompt Caching и как это помогает экономить токены?

Prompt Caching — это технология, которая позволяет сохранять статические части промпта (системные инструкции, базовый контекст) в кэше модели на несколько минут. Все последующие запросы в рамках этого времени «читают» кэшированную часть по сниженной цене (в 10 раз дешевле обычной обработки) и обрабатывают только новую динамическую часть. Это критически важно для массовых операций — например, генерации описаний товаров, где шаблон инструкций не меняется.

Можно ли заранее узнать, сколько токенов займет мой текст?

Да, для этого существуют специальные инструменты-токенизаторы. Для моделей OpenAI (GPT-4, GPT-4o) используйте библиотеку tiktoken (доступна как веб-версия и Python-библиотека). Для Claude можно использовать официальный токенизатор Anthropic. Эти инструменты показывают точное количество токенов для вашего текста еще до отправки запроса в модель.

Влияет ли длина промпта на качество ответа модели?

Не всегда. Более длинный промпт не означает лучший результат. Часто излишняя детализация и повторы только запутывают модель. Оптимальный промпт — это четкий, структурированный текст без воды. Исследования показывают, что промпты объемом 100–300 токенов работают эффективнее промптов на 800+ токенов для большинства задач. Исключение — случаи, когда вам нужно загрузить большой контекст (документы, данные), но и там лучше использовать компрессию.

Какая модель самая дешевая для регулярного использования?

На текущий момент самые бюджетные модели — это GPT-4o mini ($0.15 за 1M входных токенов) и Gemini 1.5 Flash ($0.075 за 1M). Они отлично подходят для массовой генерации простого контента, чат-ботов, быстрых ответов. Но для сложных аналитических задач, кодинга или работы с большими объемами данных лучше использовать GPT-4o или Claude Sonnet — они дороже, но качество результата окупает разницу в цене.

Как понять, что я трачу слишком много токенов?

Если вы регулярно работаете с ИИ через API, следите за статистикой расхода токенов в панели управления провайдера (OpenAI Dashboard, Anthropic Console и т.д.). Красные флаги: резкий рост расходов при том же объеме задач, большая разница между входными и выходными токенами (если выходных в 5+ раз больше — модель генерирует слишком длинные ответы), частые ошибки переполнения контекстного окна. Если видите эти признаки — пора оптимизировать промпты.

Можно ли использовать эмодзи в промптах или это лишние токены?

Эмодзи технически можно использовать, но они очень неэффективны по токенам. Один эмодзи может занимать от 2 до 4 токенов в зависимости от кодировки. Если ваша задача — экономия токенов, лучше заменить эмодзи обычным текстом. Вместо «✅ Сделай это» пишите «Сделай это». Разница кажется мелочью, но при массовом использовании накапливается.

Что делать, если модель обрезает ответ из-за лимита токенов?

Это означает, что вы достигли лимита контекстного окна или лимита выходных токенов для модели. Решения: (1) Сократите входной контекст — удалите лишнюю историю диалога или используйте компрессию документов. (2) Разбейте задачу на части — вместо «напиши статью на 3000 слов» попросите сначала план, затем генерируйте по разделам. (3) Используйте модель с большим контекстным окном (например, Gemini 1.5 Pro с 2M токенов).

Стоит ли переводить промпты на английский для экономии токенов?

Если вы работаете на русском языке, но ответ можете получить на английском — да, это может сэкономить до 50% токенов на выходе. Но если вам нужен русскоязычный результат, перевод промпта на английский даст минимальный эффект (экономия только на входных токенах, которые дешевле в 4–5 раз). Более эффективная стратегия — оптимизировать структуру промпта и убрать лишние слова независимо от языка.