Вы отправляете один и тот же промпт дважды — и получаете два совершенно разных ответа. ChatGPT то пишет строго и по делу, то уходит в вольные интерпретации. Большинство пользователей списывают это на «непредсказуемость нейросети». На самом деле за этим стоит конкретный параметр — температура (temperature), — который определяет, насколько случайно языковая модель выбирает следующее слово при генерации текста.

Понимание и использование этого параметра — один из базовых навыков в работе с искусственного интеллекта. Даже если у вас нет доступа к API и вы работаете через обычный интерфейс ChatGPT, знание того, как temperature влияет на ответы, позволяет управлять поведением модели через формулировку промпта. Разберём простыми словами: что это, как работает и как применять на практике.

Что такое температура в ChatGPT: объяснение без математики

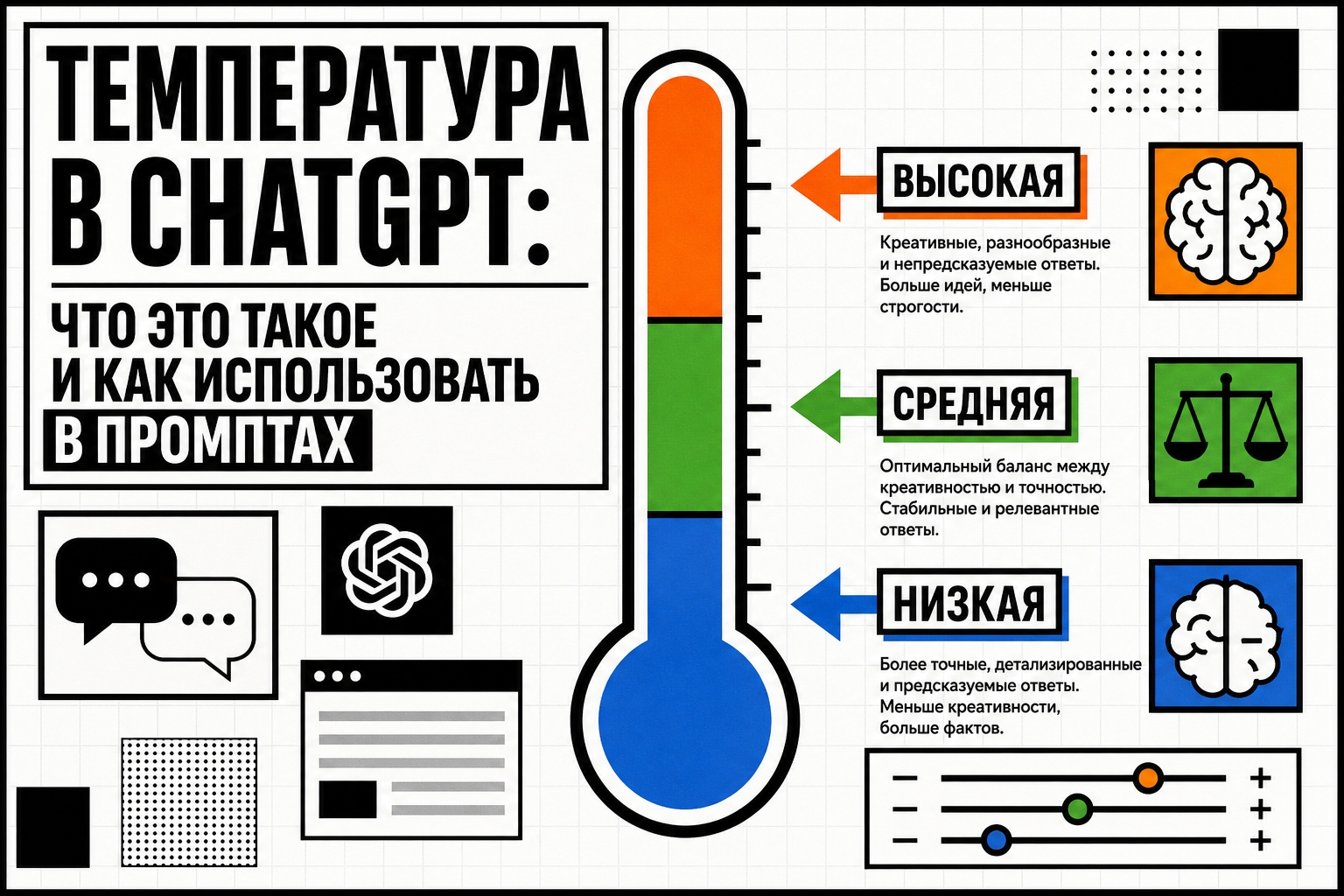

Температура в ChatGPT — это параметр, который определяет степень случайности при выборе следующего слова в ответе модели. Языковые модели на каждом шаге генерации текста оценивают все возможные варианты следующего токена и присваивают каждому вероятность. Параметр temperature управляет тем, насколько строго модель следует этому распределению вероятностей: при низком значении она выбирает только самые вероятные слова, при высоком — готова рискнуть и взять менее очевидный, но потенциально более интересный вариант.

Представьте нейронную сеть как опытного редактора. При низкой температуре этот редактор — педант: он всегда выбирает самое правильное, самое нейтральное слово. При высокой температуре тот же редактор работает в режиме мозгового штурма — допускает нестандартные формулировки, более яркие образы, неожиданные повороты. Важно понимать: temperature не меняет знания модели об искусственном интеллекте или языке. Он меняет только то, как модель использует эти знания при генерации — регулирует случайность, а не интеллект.

Я впервые столкнулась с параметром temperature, когда писала серию постов для клиента и заметила: один и тот же промпт утром и вечером давал принципиально разные тексты по стилю. Начала разбираться — и поняла, что всё дело в настройке температуры по умолчанию в разных инструментах. С тех пор я всегда уточняю этот параметр в техническом задании, когда работаю с AI-контентом через API. Если вы пишете промпты для регулярных задач — это первое, что стоит понять про машинное обучение и поведение модели.

Как temperature влияет на ответ модели: от 0 до 2

Диапазон значений температуры в большинстве языковых моделей — от 0 до 2. Значение температуры тем более влияет на выходные данные модели, чем дальше оно от центральной точки 1.0. При низком значении модель генерирует текст предсказуемо: выбирает только самые вероятные слова и придерживается наиболее вероятного варианта на каждом шаге. При высоком значении распределение вероятностей «расплющивается» — менее вероятные слова получают больший шанс, ответы становятся более случайными и разнообразными. Понять это проще всего через конкретные сценарии.

| Температура | Поведение модели | Лучший сценарий | Пример задачи |

|---|---|---|---|

| 0 | Полностью детерминированный. Всегда выбирает наиболее вероятный вариант | Извлечение данных, JSON, нормализация | «Выдели ИНН и дату из текста, выведи в JSON» |

| 0.1–0.3 | Очень точный. Генерация точных ответов, минимум вариативности | Код, SQL, юридические тексты, перевод | «Напиши SQL-запрос для выборки заказов за 30 дней» |

| 0.4–0.7 | Баланс. Связные тексты с умеренной вариативностью формулировок | Статьи, объяснения, деловая переписка | «Объясни разницу между top-p и temperature» |

| 0.8–1.0 | Креативный. Заметное разнообразие, более яркие формулировки и образы | Маркетинг, заголовки, сторителлинг, слоганы | «Придумай 10 слоганов для AI-сервиса» |

| 1.1–1.5 | Непредсказуемый. Нестандартные комбинации, выше риск несвязного текста | Брейнсторм, концепты, художественных текстов черновики | «Сгенерируй сумасшедшие концепты для нового продукта» |

| >1.5 | Хаотичный. Текст может стать бессмысленным набором слов | Эксперименты, тестирование границ модели | Только для технических тестов, не для продакшена |

Оптимальные сценарии использования temperature зависят не только от задачи, но и от конкретной модели. Большинство специалистов по prompt engineering рекомендуют держать значение в диапазоне 0–0.3 для задач, требующих точных ответов, и 0.7–1.0 для creative text generation. Значения выше 1.5 на практике почти не используются — выходные данные модели становятся непригодными для реальных задач.

Какая температура стоит по умолчанию в ChatGPT, Claude и Gemini

Большинство пользователей работают с дефолтными настройками температуры и даже не подозревают об этом. Когда вы открываете ChatGPT, Claude или Gemini через обычный интерфейс, модель уже работает с заранее заданным значением параметра. Хорошая новость: все три ведущих модели используют одинаковый дефолт — 1.0. Однако диапазон и возможности настройки temperature values у них различаются, и это важно понимать при выборе инструмента для конкретных задач.

| Модель | Диапазон | Дефолт | Где менять |

|---|---|---|---|

| ChatGPT GPT-4o | 0 — 2 | 1.0 | API / Playground |

| Claude (Anthropic) | 0 — 1 | 1.0 | API / Console |

| Gemini (Google) | 0 — 2 | 1.0 | Vertex AI / API |

| Reasoning-модели (o-серия) | фиксирован | только 1.0 | Недоступно |

Из моего опыта: 90% маркетологов, с которыми я работаю, никогда не меняли настройки температуры — они просто не знали, что такой параметр существует. При этом они жалуются, что ChatGPT «пишет одинаково» или «слишком сухо». Это именно про дефолт. Если вы работаете через обычный интерфейс ChatGPT, вы всегда получаете temperature 1.0 — и это нормальный баланс для большинства задач. Но как только вы начинаете использовать API или такие инструменты как режим chatgpt в сторонних сервисах — появляется возможность настраивать температуру под конкретные нужды. Пользователи могут добиться принципиально разных результатов от одной и той же модели, просто изменив одно число.

Как управлять температурой через промпт — без доступа к API

У большинства пользователей нет доступа к API и возможности крутить ползунок температуры вручную. Но это не значит, что вы не можете управлять поведением модели. Формулировка промпта — это ваш косвенный инструмент prompt engineering: конкретные слова и фразы в запросе меняют то, как ChatGPT расставляет приоритеты при выборе следующего слова. Строгие рамки и требование единственного ответа снижают вариативность — модель ведёт себя как при низкой температуре. Открытые формулировки и запрос на разнообразия и креативности дают обратный эффект. Это не магия, а промпт инжиниринга на практике.

- «Отвечай строго по фактам, без предположений и домыслов»

- «Дай один лучший вариант, не перечисляй альтернативы»

- «Если данных недостаточно — напиши "не знаю", не додумывай»

- «Структурируй ответ как чёткий алгоритм по шагам»

- «Используй формальный стиль, без метафор и образных выражений»

- «Предложи минимум 5 вариантов — от банальных до смелых»

- «Используй неожиданные метафоры, аналогии и нестандартные примеры»

- «Пиши свободно, разговорным языком, допускается юмор»

- «Сначала набрось широкий спектр идей, потом выбери самые оригинальные»

- «Предложи версии, даже если они кажутся маловероятными или неожиданными»

Недавно тестировала это на реальном проекте: нужно было написать статью для корпоративного блога. Промпт без уточнений дал средний текст — нейтральный, без характера. Добавила в запрос «используй конкретные примеры, более яркими деталями, пиши как эксперт-практик» — результат стал принципиально другим. Это не магия, это управление level of creativity через слова и фразы. Именно поэтому я всегда говорю подписчикам: прежде чем жаловаться на ChatGPT, посмотрите на свой промпт. Чтобы chatgpt дал нужный результат, ваш запрос должен содержать точные инструкции по стилю и формату.

Готовые промпты с нужным режимом точности

Протестируй разные стили формулировок прямо сейчас — без регистрации

Почему новые reasoning-модели убирают контроль температуры у пользователя

В 2025 году наметился устойчивый тренд: новые reasoning-модели либо фиксируют temperature на значении 1.0, либо полностью закрывают этот параметр для внешнего управления. OpenAI o-серия — первые модели, которые принимают только temperature=1.0. Попытка задать другое значение через API приводит к ошибке валидации. Логика понятна: reasoning-модели используют внутренние механизмы «рассуждения», которые оптимизированы под конкретный generation process. Ручное изменение temperature в этом случае не улучшает, а нарушает generation behavior — модель использует уже откалиброванное распределение вероятностей, и вмешательство в него ухудшает качество consistent outputs.

Google пошёл ещё дальше: для Gemini 3 компания официально рекомендует не менять параметр который определяет случайность вывода — в документации прямо указано, что снижение температуры может привести к деградации производительности при сложных задачах. Anthropic со своей стороны добавляет важную оговорку: даже когда temperature установлена на 0, результаты не будут полностью идентичными при повторных запросах — из-за особенностей распределённого инференса и параллельных вычислений. Это important to note для всех, кто рассчитывает на абсолютную воспроизводимость: control text generation через temperature имеет технические пределы вне зависимости от настроек.

Топ-5 мифов о температуре в ChatGPT, которые мешают работать

Важно понимать: большинство заблуждений о параметре temperature возникают из-за поверхностного знакомства с тем, как языковые модели генерируют текст. Разберём самые частые — и то, как они влияют на качество вашей работы с ChatGPT.

Самый частый миф, который я вижу у подписчиков — второй: «чем выше температура, тем умнее ответ». Люди поднимают T до максимума, получают красивый, цветистый, но фактически ошибочный текст — и думают, что ChatGPT «постарался». На деле модель просто выбирала менее вероятные слова, и ответы могут стать более «звучными», но менее точными. Я всегда объясняю это так: высокая температура — это не кнопка «умнее», это кнопка «смелее». А смелость без фактуры — это просто красивые ошибки.

Как протестировать разные значения температуры прямо сейчас

Использовать ChatGPT для проверки эффекта температуры можно без API и без технических знаний — через правильную формулировку промпта. Возьмите любую задачу и запустите её дважды: один раз с инструкцией в «точном» режиме, второй — в «креативном». Сравним результаты — и разница станет очевидной. Это наглядные примеры того, как одна и та же нейросеть chatgpt ведёт себя принципиально по-разному в зависимости от того, как сформулирован запрос. Ниже — готовый сценарий для самостоятельного теста.